AWSにおける生成AIの監査とコンプライアンスの高速化

生成AIは、テキスト、画像、音声、その他のコンテンツを生成できる強力なツールです。しかし、その出力の正確性、公平性、プライバシー、セキュリティ、持続可能性を確保するためには、責任ある開発と展開が不可欠です。本記事では、AWSにおける生成AIの監査とコンプライアンスを高速化する方法について解説します。

生成AIの監査とコンプライアンスは、従来のAI/MLとは異なる課題を提示します。予測AI/MLでは、監査証跡は普遍的であり、例えばS3が暗号化されていることを確認すれば十分でした。しかし、生成AIでは、監査証跡は文脈に依存し、データに偏りがないことを確認する必要があります。

生成AIと予測AI/MLの違い

生成AIと予測AI/MLの主な違いは以下の通りです。

| 項目 | 予測AI/ML | 生成AI |

|---|---|---|

| 監査証跡 | 普遍的(例:「S3が暗号化されている」) | 文脈依存(例:「データに偏りがない」) |

| 機能 | 分類、グループ化、予測 | パターンに基づいて新しいコンテンツを作成(テキスト、画像) |

| 使用される入力 | 有限のトレーニングデータ | 非常に広範なデータ。構造化データ、大規模言語モデル、非構造化データ |

| 精度 | ビジネスデータとユースケースに固有 | 広範なユースケースにわたって一般化 |

| 結果の性質 | 出力は予測可能で具体的 | 出力はいくぶん予測不可能 |

予測AI/MLは、特定のビジネスデータとユースケースに固有の有限のトレーニングデータセットに基づいて、狭範囲内の予測可能な出力を生成します。一方、生成AIは、広範なユースケースにわたって一般化された大規模言語モデルを使用して、非常に広範なデータから予測不可能な新しいコンテンツを作成します。

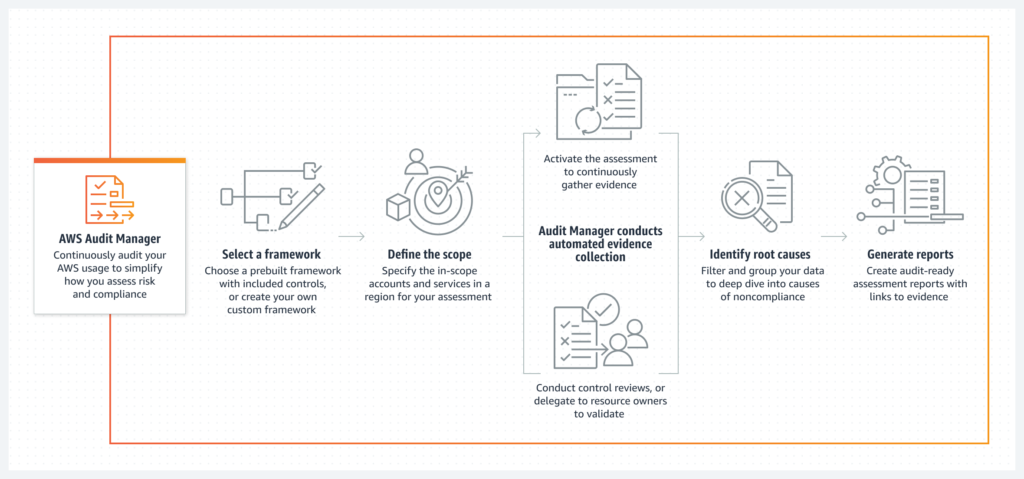

AWS Audit Managerフレームワーク

AWSは、生成AIの責任ある使用を促進するため、AWS Audit Managerフレームワークを立ち上げました。このフレームワークは、Deloitteと共同で開発され、8つのドメインにわたって110の管理策を含んでいます。

- 正確性

- 公平性

- プライバシー

- 耐障害性

- 責任

- 安全性

- セキュリティ

- 持続可能性

これらのドメインには、生成AIアプリケーションのライフサイクル全体にわたるベストプラクティスとコントロールが含まれています。このフレームワークは、顧客が生成AIの監査とコンプライアンスに関する不確実な状況を乗り越え、責任あるAI開発を進めるための明確なロードマップを提供します。

チャットボットアプリケーションを例に解説

架空の生成AIアプリケーション「チャットボット」を例に、さまざまなドメインにおけるベストプラクティスと考慮事項について説明します。チャットボットは、ユーザーが質問を入力すると、生成AIモデルが回答を生成するチャットボットです。

正確性

チャットボットは、正確な情報と信頼性の高いソースを提供する必要があります。例えば、ユーザーが「Amazon SQSを使用してCloudTrailデータを分析できますか?」と質問した場合、アプリケーションは正しい回答を提供する必要があります。ただし、生成AIモデルは常に正確な情報を提供するとは限らないため、出力の正確性を確保するためのプロセスとコントロールが必要です。

モデル評価は、Bedrockの機能であり、モデルの出力の正確性を評価するために使用できます。例えば、ユーザーの質問に対して、モデルが不適切または不正確な回答を生成する可能性があります。モデル評価では、一連のプロンプトをモデルに送信し、その回答を評価して、モデルが意図したとおりに機能しているかどうかを判断できます。

公平性

チャットボットは、すべてのユーザーを公平かつ平等に扱う必要があります。モデルの出力にバイアスがかかっていないことを確認することが重要です。例えば、ユーザーが受付係について質問した場合、モデルが受付係を常に女性と想定するようなバイアスが含まれていないことを確認する必要があります。

バイアスアセスメントは、トレーニングデータとモデル出力を評価して、バイアスが存在するかどうかを判断するプロセスです。統計的テストや視覚化など、さまざまなバイアス検出技術を使用できます。データ拡張、アルゴリズム調整、後処理など、バイアスを軽減するための戦略を導入することもできます。

プライバシー

チャットボットは、ユーザーのプライバシーを保護する必要があります。これは、個人を特定できる情報(PII)を収集、保存、処理する方法を慎重に検討することを意味します。例えば、ユーザーの健康状態やクレジットカード番号などの機密情報が、モデルの出力に含まれていないことを確認する必要があります。

差分プライバシーは、データセットにノイズを導入することで、個々のユーザーのプライバシーを保護する手法です。例えば、病院が特定の症状を持つ患者の平均年齢を公開したいが、個々の患者の年齢がその公開データから推測できないようにしたい場合、差分プライバシーを使用できます。

耐障害性

チャットボットは、障害が発生した場合でも引き続き機能する必要があります。これは、高可用性とディザスタリカバリのベストプラクティスを実装することを意味します。例えば、DynamoDBテーブルのPoint in Time Recovery(PITR)を有効にして、データの損失や破損から保護することができます。

責任

チャットボットは、倫理的かつ責任ある方法で使用する必要があります。これは、モデルの出力が意図したとおりに使用され、有害な結果をもたらさないようにするためのガードレールを設定することを意味します。例えば、ユーザーが核爆弾の作り方を質問した場合、アプリケーションは「申し訳ありませんが、生き物を殺したり危害を加えたりする方法を推奨することはできません。」と回答する必要があります。

安全性

チャットボットは、ユーザーの安全を脅かさないようにする必要があります。これは、特に自動運転車やロボットなどの物理システムに生成AIが使用される場合に重要です。高い精度は、これらのシステムの安全な運用を確保するために不可欠です。

セキュリティ

チャットボットは、不正アクセスやデータ漏洩から保護する必要があります。これは、適切なセキュリティ対策を実装することを意味します。例えば、AWS Configを使用して、DynamoDBテーブルが暗号化されていることを確認することができます。

持続可能性

チャットボットは、環境への影響を最小限に抑えるように設計および展開する必要があります。AWSは、エネルギー消費を削減したデータセンターの構築に取り組んでいます。Gravitonプロセッサなど、より効率的なハードウェアも開発しています。生成AIアプリケーションを開発する際には、持続可能性を考慮することが重要です。

まとめ

生成AIは、さまざまなユースケースで大きな可能性を秘めていますが、責任ある方法で開発および展開することが重要です。AWS Audit Managerフレームワークは、生成AIアプリケーションの監査とコンプライアンスを高速化するための明確なロードマップを提供します。また、AWS Config、CloudTrail、Incident Managerなどのツールは、生成AIワークロードの安全性、セキュリティ、持続可能性を確保するのに役立ちます。

生成AIは急速に進化している分野であり、新しい規制やベストプラクティスが常に登場しています。生成AIワークロードの監査とコンプライアンスの最新情報を入手し、関連する法律や規制を常に把握しておくことが重要です。

データ分析基盤構築とデータ活用支援、AWSモダナイズ開発、基幹業務システムのUI.UX刷新はお気軽にお問い合わせください。

スモールスタート開発支援、サーバーレス・NoSQLのことなら

ラーゲイトまでご相談ください

低コスト、サーバーレスの

モダナイズ開発をご検討なら

下請け対応可能

Sler企業様からの依頼も歓迎