Ollama 0.21 の新機能とは

2026年4月、Ollama の最新バージョン v0.21.0 がリリースされました。このリリースで最も注目すべき追加機能が、ollama launch hermes コマンドです。このコマンドひとつで、NousResearch が開発した自己改善型 AI エージェント「Hermes Agent」をローカル環境にすぐ立ち上げられるようになりました。

これまでローカル LLM でエージェントを動かすには、モデルのダウンロード・エンドポイントの設定・エージェントフレームワークの構築など、複数のステップを手動でこなす必要がありました。v0.21.0 ではこれらをワンコマンドで自動化します。

ollama launch hermes

コマンドを実行すると、Hermes Agent のインストール・モデルの選択・ローカルエンドポイント(http://127.0.0.1:11434/v1)の設定・プラットフォーム統合までが一括で処理されます。

v0.21.0 ではほかにも、Apple Silicon Mac 向けに Gemma 4 の MLX サポートと GitHub Copilot CLI 統合が追加されました。Gemma 4 の MLX 対応により、M シリーズチップを搭載した Mac でより高速にモデルを実行できるようになっています。

Hermes Agent とはどんなエージェントか

Hermes Agent は NousResearch が開発したオープンソースの AI エージェントです。GitHub でスター数 95,600 以上を獲得しており(2026年4月時点)、そのキャッチコピーは「The agent that grows with you(あなたと共に成長するエージェント)」です。

最大の特徴は自己改善機能にあります。エージェントはタスクを実行するたびに、その経験をスキルファイル(~/.hermes/skills/)として保存します。同じカテゴリのタスクを次回以降に受けたとき、学習済みのスキルを自動的に再利用することで、精度と速度が向上していく仕組みになっています。

組み込みツールは 47 種類以上を備えており、以下のような操作をエージェントが自律的に実行できます。

- Web 検索・情報収集

- ターミナルコマンドの実行

- ブラウザの自動化

- ファイルの読み書き

- コードの生成と実行

また、Slack・Telegram・Discord など 15 種類以上のメッセージングプラットフォームと統合できるため、普段使いのツールから直接エージェントを操作できます。

なお「Hermes」という名前は、Ollama と Hermes Agent の両方で使われているため混同しやすいですが、区別して理解することが重要です。NousResearch の「hermes3」は Ollama ライブラリで公開されている LLM モデルであり、Hermes Agent はそのモデルをベースに構築されたエージェントフレームワークです。

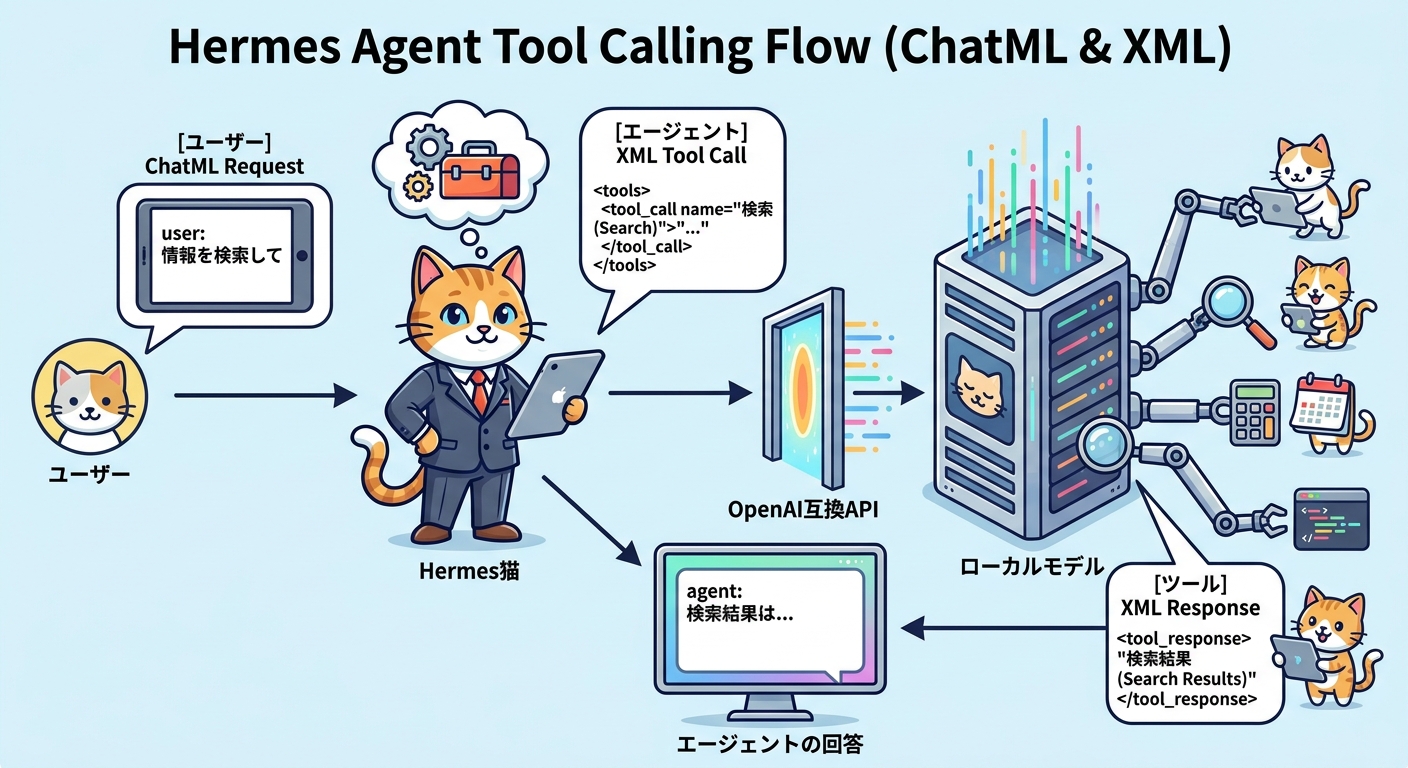

Tool Calling の実装と OpenAI 互換 API との連携

Hermes モデルは ChatML 形式と XML タグを組み合わせた独自の Tool Calling 仕様を採用しています。システムプロンプト内に <tools> タグでツール定義を記述し、モデルが <tool_call> タグでツールを呼び出し、<tool_response> タグで結果を受け取る流れになっています。

Ollama は OpenAI 互換 API(http://localhost:11434/v1/chat/completions)を提供しているため、既存の OpenAI SDK や HTTP クライアントをそのまま流用できます。リクエストボディに tools 配列でツール定義を渡し、tool_choice に auto を指定することで、モデルがユーザーの意図を判断して適切なタイミングでツールを自律的に選択します。

レスポンスにはモデルが選択したツール名と引数が含まれます。アプリケーション側でそのツールを実行し、結果を tool ロールのメッセージとして返すと、モデルが最終回答を生成します。OpenAI SDK を使う場合も、base_url を http://localhost:11434/v1 に変更するだけで既存のコードをそのまま流用できます。外部 API を一切使わず、ローカルモデルだけでこの機能を実現できることが Ollama の大きな強みです。

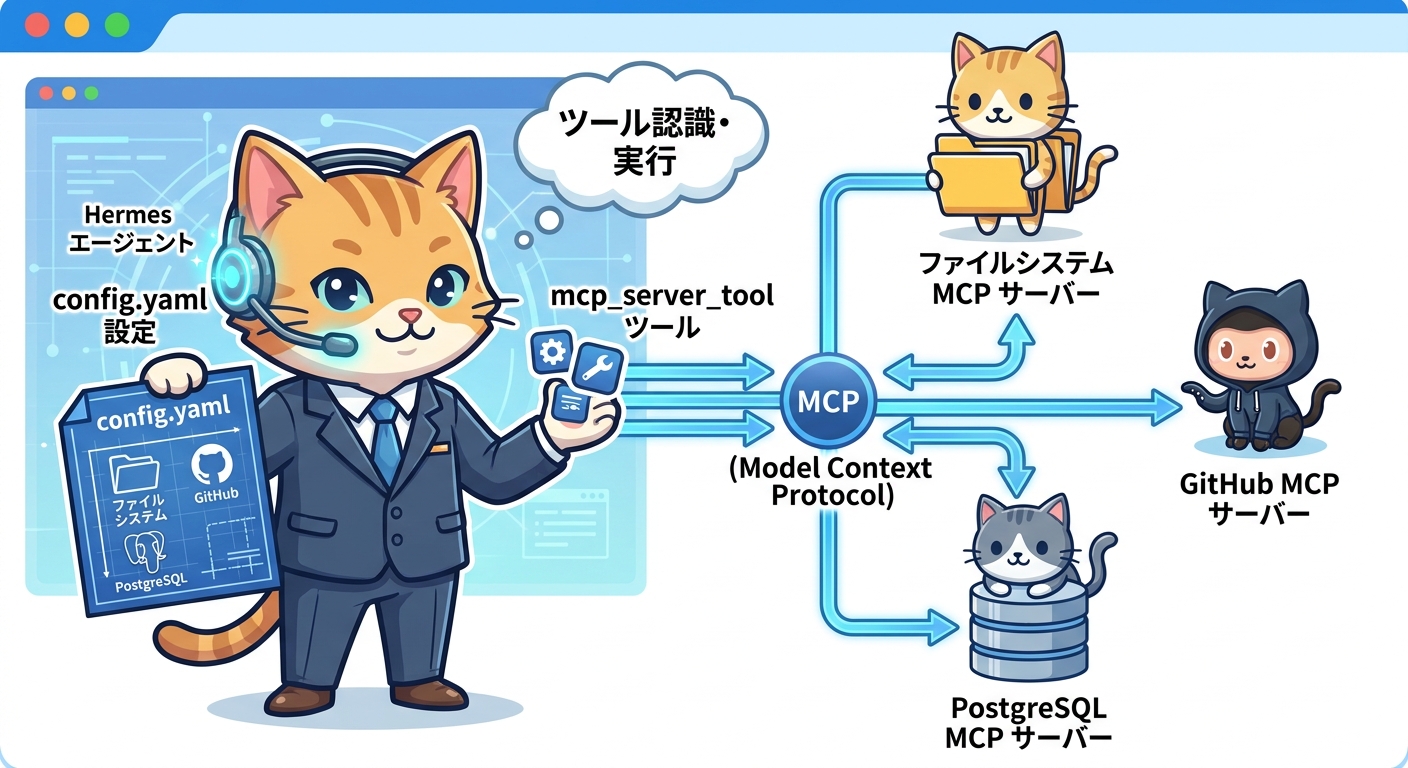

MCP(Model Context Protocol)との連携

AI エージェント界隈で注目を集めている MCP(Model Context Protocol)との連携について解説します。Anthropic が提唱したこのプロトコルは、LLM と外部ツール・データソースを統一的なインターフェースで接続する仕組みです。

現時点では、Ollama 本体は MCP にネイティブ対応していません(GitHub Issue #7865 で対応が議論されています)。ただし、Hermes Agent は MCP をネイティブサポートしており、設定ファイル(~/.hermes/config.yaml)に接続情報を記述するだけで任意の MCP サーバーに接続できます。

設定例として、ローカルファイルシステム・GitHub・PostgreSQL の MCP サーバーを追加する場合、以下のような JSON 相当の設定を行います。

{

"mcp": {

"servers": [

{

"name": "filesystem",

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "/home/user/documents"]

},

{

"name": "github",

"command": "uvx",

"args": ["mcp-server-github"],

"env": {"GITHUB_TOKEN": "your-token-here"}

}

]

}

}

設定後、Hermes Agent は接続されたサーバーのツールを自動的に認識し、mcp_<サーバー名>_<ツール名> という命名規則でツールとして登録します。例えば、filesystem サーバーのファイル読み込みツールは mcp_filesystem_read_file として利用可能になります。

これにより、ローカルのファイルシステム・データベース・外部サービスを Hermes Agent が自律的に操作できるようになります。Ollama 本体の MCP 対応を待たずに、エージェントレベルで幅広いツールとの統合が実現している点は非常に実用的です。

ローカルエージェントを実用するための推奨構成

Hermes Agent を実際に活用するにあたって、モデル選択と環境構成が成否を分けます。長期的なタスクをこなせるエージェントを動かすには、64K コンテキスト以上のモデルが最低条件とされています。

主な推奨モデルの比較を以下に示します。

- Qwen 3.5 27B — TAU2 Agentic Benchmark で 79% のスコアを達成。エージェント用途に最適化されており、バランスのよいモデルです。

- Gemma 4 26B MoE — Apple Silicon 向けに MLX 経由での実行に対応。M シリーズ Mac で高速に動作し、リソース効率も優れています。

- hermes3(NousResearch)— Ollama の公式ライブラリで提供。ChatML + XML のツール呼び出しに特化しており、Hermes Agent との相性が最も良いモデルです。

ローカルでエージェントを動かすことには、クラウド API では得られないメリットがあります。

- プライバシー保護 — 入力データがローカルから外部に送信されないため、機密情報を含むタスクも安全に処理できます。

- API コストの削減 — 一度モデルをダウンロードすれば、追加コストなしで無制限に利用できます。

- オフライン動作 — インターネット接続がない環境でも、ツール呼び出しを含む高度なタスクを実行できます。

- カスタマイズの自由度 — モデルパラメーターやプロンプトテンプレートを自由に調整できます。

初めて試す場合は、ollama pull hermes3 でモデルを取得し、ollama launch hermes でエージェントを起動するのが最も手軽です。Slack などすでに使用しているプラットフォームと連携すれば、日常業務の自動化をすぐに試せます。

まとめ

Ollama v0.21.0 で追加された Hermes Agent サポートは、ローカル LLM の活用領域を大きく広げるものです。ollama launch hermes というシンプルなコマンドで、47 種類以上のツールと MCP ネイティブ対応を備えたエージェントがすぐに手元で動きます。

これまでエージェント構築に必要だった複雑なセットアップが不要になり、エンジニアはエージェントの活用・改善に集中できるようになりました。スキルファイルによる自己改善の仕組みは、使い続けるほど精度と効率が向上する点でユニークです。

プライバシーを守りながら、コストをかけずにローカルでエージェントを動かせる時代が来ています。Ollama と Hermes Agent の組み合わせは、その入り口として最も手軽な選択肢の一つです。ぜひ手元の環境で試してみてください。