AWS Lambda Managed Instancesとは

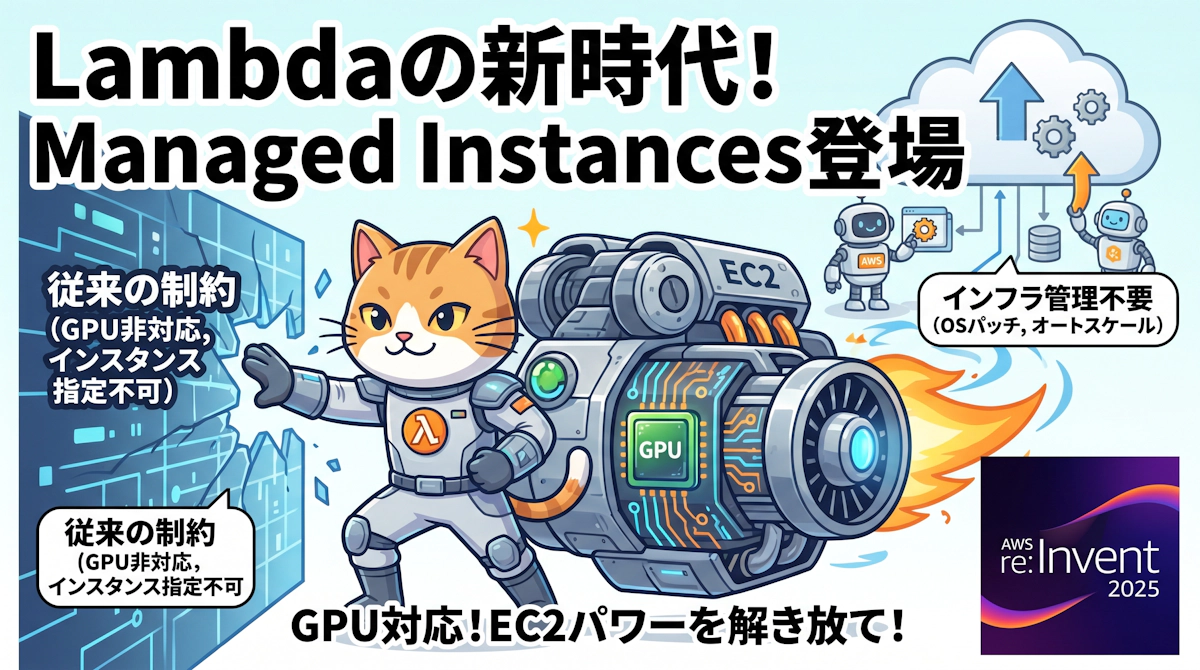

2025年のAWS re:Inventで発表されたAWS Lambda Managed Instancesは、Amazon EC2インスタンスの柔軟性とAWS Lambdaのサーバーレスな運用簡潔さを同時に実現する新機能です。

従来のAWS Lambdaは、開発者がインフラを意識せずにコードを実行できる便利なサービスとして広く普及してきました。しかし、共有実行プールを前提とした設計ゆえに、次のような制約がありました。

- 利用できるインスタンスタイプを指定できない

- GPUを搭載したインスタンスが利用できない

- 特定のCPUアーキテクチャや高帯域幅ネットワークを要求するワークロードに対応しにくい

AWS Lambda Managed Instancesはこれらの課題を解消するために設計されました。開発者はLambdaの開発体験をそのままに、EC2インスタンスタイプをキャパシティプロバイダーとして指定できます。インスタンスのライフサイクル管理、OSパッチング、ロードバランシング、オートスケーリングはすべてAWSが担当するため、従来のEC2運用と比較してインフラ管理の工数を大幅に削減できます。

AWSはこのコンセプトを「EC2コンピュート上でのLambdaの運用簡潔さ」と表現しています。サーバーレスの運用コスト削減と、EC2の豊富なコンピュートリソースを両立できる点が最大の特徴です。

主要機能と技術仕様

AWS Lambda Managed Instancesでは、用途に応じて多様なEC2インスタンスタイプを選択できます。主な対応インスタンスは以下のとおりです。

- GPU対応インスタンス:g5.2xlarge(NVIDIA A10G GPU搭載、vCPU 8、メモリ32GB)、G6シリーズ。機械学習推論や動画処理に最適です。

- 高CPUインスタンス:C7i、C7gファミリー(AWS Graviton4プロセッサ含む)。演算集約型のバッチ処理や高負荷APIに対応します。

- 高メモリインスタンス:Rファミリー。大規模データセットを展開して処理するワークロードに向いています。

これらのインスタンスはキャパシティプロバイダーという概念で管理されます。開発者はVPC、サブネット、セキュリティグループのネットワーク設定と、インスタンスタイプおよびスケーリングパラメーター(MinInstances、MaxInstances)を指定するだけで、あとはAWSが自動的にインスタンスのセットアップから管理までを担当します。

対応するランタイムは2026年4月時点でPython 3.13、Node.js 24、.NET 10、Rustです。特にRustは2026年3月に追加され、パフォーマンスを重視するシステムプログラミング用途でも活用できるようになりました。今後もランタイムの追加が予定されています。

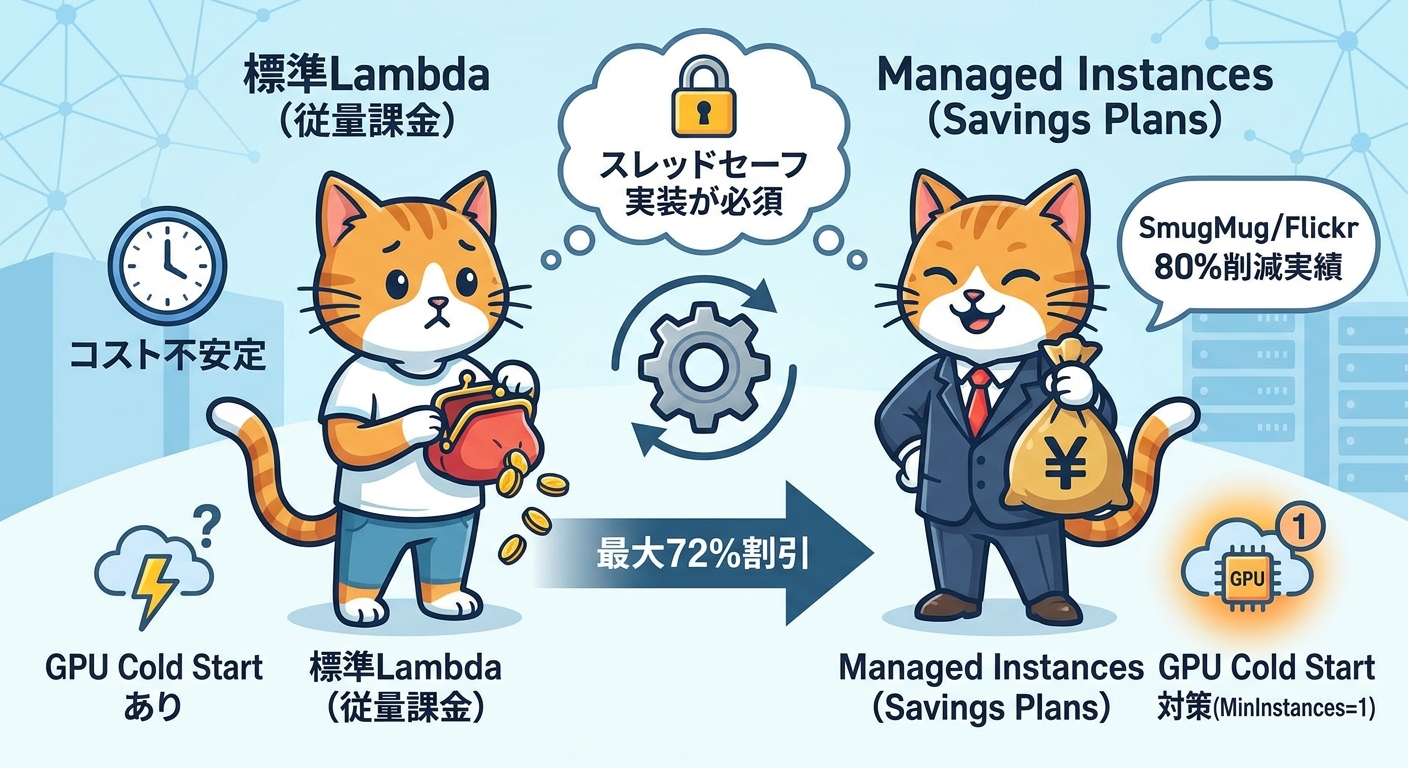

また、マルチコンカレンシーも重要な特徴のひとつです。1つの実行環境が複数のリクエストを同時に処理できるため、コールドスタートを最小化した事前プロビジョニング済みの実行環境を効率的に活用できます。ただし、マルチコンカレンシーを利用する場合は、コードがスレッドセーフに実装されている必要があります。共有メモリやグローバル変数の扱いには注意が必要です。

どんな課題を解決するのか、主なユースケース

AWS Lambda Managed Instancesが特に力を発揮するユースケースを紹介します。

機械学習推論(GPU活用):従来のLambdaではGPUインスタンスが利用できなかったため、機械学習モデルの推論処理にはSageMakerやECSなど別のサービスが必要でした。Lambda Managed Instancesを使えば、g5.2xlarge(NVIDIA A10G GPU搭載)などのGPUインスタンスをLambdaの開発体験で利用できます。画像認識や自然言語処理の推論APIを低い運用コストで構築できます。

動画トランスコーディング:大量の動画ファイルをリアルタイムにエンコード・変換する処理は、高いCPUリソースを要求します。C7iやC7gファミリーのような高CPUインスタンスをLambda関数に紐付けることで、スケーラブルなトランスコーディングパイプラインをサーバーレスで構築できます。

大規模ドキュメント処理:大量のPDFや文書データを解析・変換するワークロードでは、高メモリのRファミリーインスタンスが有効です。ETL処理やデータパイプラインにも応用でき、クラウドマイグレーション案件でも活用できるアーキテクチャです。

高スループットAPIサービス:高いネットワークスループットと大量の同時接続を必要とするAPIサービスも、Lambda Managed Instancesの得意領域です。高帯域幅ネットワークオプションを持つインスタンスと組み合わせることで、これまでEC2やFargateで構築していたようなAPIをよりシンプルに運用できます。

写真共有サービスのSmugMug/FlickrはAWS Lambda Managed Instancesを採用し、コストを最大80%削減しながらパフォーマンスを向上させることに成功しました(AWS公式情報)。大規模な画像処理ワークロードにおけるコスト効率と性能の両立を示す具体的な事例です。

キャパシティプロバイダーの設定方法

AWS Lambda Managed Instancesを利用するには、キャパシティプロバイダーを設定し、Lambda関数に紐付けます。設定の主な項目は以下のとおりです。

- ネットワーク設定:VPC、サブネット(マルチAZ構成を推奨)、セキュリティグループ(必要なポートのみ開放)を指定します。

- インスタンス設定:InstanceTypeで用途に合ったEC2インスタンスタイプを指定します。複数タイプの組み合わせも可能です。Tenantはsharedまたはdedicatedのいずれかを選択できます。

- スケーリング制御:MinInstancesで常時ウォーム状態に保つインスタンス数を、MaxInstancesでバースト時に許容する最大スケール数をそれぞれ指定します。

GPUインスタンス(g5.2xlarge等)を利用する場合は特に注意が必要です。GPUドライバの初期化にコールドスタートで約30〜60秒かかるため、MinInstances=1に設定してウォームアップ済みのインスタンスを常時維持することを推奨します。これにより、初回リクエストのレイテンシーを大幅に抑えられます。

また、マルチコンカレンシーを有効化する場合はスレッドセーフなコード実装が必須です。グローバル変数や共有メモリへの書き込みは複数リクエストの競合を引き起こす可能性があるため、設計段階から意識する必要があります。

コスト最適化と標準Lambdaとの使い分け

AWS Lambda Managed Instancesの料金体系は、標準Lambdaとは異なります。主な構成要素は次のとおりです。

- リクエスト料金:100万リクエストあたり$0.20

- EC2インスタンス料金:選択したインスタンスタイプに基づく料金。Compute Savings PlansまたはReserved Instancesを適用することで最大72%の割引が可能です。

標準Lambdaは実行時間に比例した従量課金モデルですが、Lambda Managed Instancesでは実行期間による追加料金が発生しない構造になっています。長時間・高頻度で稼働するワークロードでは、Savings Plansとの組み合わせで大幅なコスト削減が期待できます。

以下に、標準LambdaとManaged Instancesの主な違いをまとめます。

項目 | 標準Lambda | Lambda Managed Instances |

|---|---|---|

インフラ管理 | AWSが全管理 | AWSが全管理(EC2上) |

インスタンスタイプ指定 | 不可 | 可能(GPU・高CPUなど) |

コールドスタート | あり | 最小化(事前プロビジョニング) |

GPU利用 | 不可 | 可能 |

コスト最適化 | 従量課金のみ | Savings Plans/RIで最大72%割引 |

マルチコンカレンシー | 1環境=1リクエスト | 1環境=複数リクエスト同時処理 |

標準Lambdaは短時間・低頻度のイベント駆動処理に最適です。一方、Lambda Managed InstancesはGPU・大規模メモリ・高CPU・高いスループットを必要とするワークロードや、継続的に稼働するサービスでのコスト最適化に向いています。用途に応じて両者を使い分けることがポイントです。

今後の展望とRagateとの親和性

AWS Lambda Managed Instancesはまだ発表から日が浅い機能ですが、今後の発展も注目されます。現時点で対応するランタイムはPython 3.13、Node.js 24、.NET 10、Rustの4種類ですが、今後さらに追加されることが予告されています。

特に生成AIや機械学習の推論基盤としての活用が有望です。GPUインスタンスをLambdaの手軽さで利用できるため、モデルの推論APIをサーバーレスで構築するユースケースが広がります。Graviton4プロセッサを搭載した高CPUインスタンスとの組み合わせにより、コスト効率の高いAI推論パイプラインの実現が期待されます。

Ragate株式会社はAWSパートナーとして、Lambda・サーバーレスアーキテクチャを活用したクラウドマイグレーションやMVP開発の支援を多数手がけてきました。AWS Lambda Managed Instancesは、RagateがこれまでEC2やSageMakerを使って構築してきたような高負荷ワークロードを、よりシンプルかつコスト効率よく提供できる可能性を広げます。

「サーバーレスを使いたいが、GPUや大規模コンピュートリソースが必要」「EC2の運用管理工数を減らしながらパフォーマンスを維持したい」といった要件でお悩みの場合は、ぜひRagateへご相談ください。AWS Lambda Managed Instancesを活用したアーキテクチャ設計から実装・運用まで、一気通貫で支援いたします。