AWS の AI コーディングツール Kiro に、新たに MiniMax M2.5 と GLM-5 の2モデルが追加されました。いずれもオープンウェイトモデルでありながら、フロンティアクラスのコーディング性能を大幅に低いクレジットコストで実現しています。本記事では、各モデルの特徴と、エージェント開発・大規模リポジトリ処理といった実務シナリオでどのように活用できるかを解説します。

Kiro のオープンウェイトモデル戦略

Kiro はこれまでも複数のモデルを選択可能な IDE として機能してきましたが、2026年のアップデートにより DeepSeek・Qwen に続いてオープンウェイトモデルのラインナップがさらに拡充されました。オープンウェイトモデルをクローズドモデルと同等の UX で利用できることが Kiro の特徴であり、今回追加された2モデルはそのコストパフォーマンスと長大なコンテキスト処理能力において特に注目に値します。

クレジット乗数という概念を簡単に説明すると、Kiro では各モデルの利用量に応じてクレジットが消費されます。乗数が低いほど同じ操作に消費するクレジットが少なくなります。MiniMax M2.5 の 0.25x、GLM-5 の 0.5x という数値は、フロンティアモデルと比べて大幅な節約が可能であることを意味しています。長時間のエージェントセッションや反復的な実装タスクにおいては、この差は積み重なって非常に大きなコスト削減につながります。

以下では各モデルの詳細を確認していきます。

MiniMax M2.5 の特徴 — 0.25倍クレジットで SWE-Bench 80.2%

MiniMax M2.5 は中国の AI スタートアップ MiniMax が開発した、実用性に特化した大規模言語モデルです。アーキテクチャは 230B パラメータの Mixture-of-Experts (MoE) を採用しており、推論時に活性化されるのはそのうち約 10B パラメータのみです。これにより、大規模モデルの表現力を保ちながら、推論コストと速度を大幅に改善しています。

コーディングベンチマークでの成績は特筆すべきものがあります。実際の GitHub Issue を自律的に解決するタスクを評価する SWE-Bench Verified では 80.2% というスコアを達成しており、フロンティアモデルと肩を並べる水準です。また Multi-SWE-Bench で 51.3%、Web ブラウジングを必要とするタスクを評価する BrowseComp で 76.3% を記録しています。

Kiro での仕様は以下の通りです。

- コンテキストウィンドウ: 200,000 トークン

- クレジット乗数: 0.25x(フロンティアモデルの4分の1)

- 対応リージョン: US East (N. Virginia)、EU (Frankfurt)

- 対応ティア: Free、Pro、Pro+、Power

強化学習を通じて数十万の実環境タスクで訓練されているため、マルチステップの実装タスクや長時間のエージェントセッションにおいても安定したパフォーマンスを発揮します。特に「ファイルを横断してバグを特定し修正する」「テストを自動生成しながら実装を進める」といったエージェント的なワークフローに最適化されています。前バージョンの M2.1 と比較して SWE-Bench の評価完了速度が 37% 向上しており、高速なフィードバックループが求められる開発現場での実用性が高まっています。

GLM-5 の特徴 — 745B MoE と 200K コンテキストが解決する大規模開発

GLM-5 は清華大学発の AI 企業 Zhipu AI が開発した、次世代の汎用大規模言語モデルです。総パラメータ数は約 745B という規模を誇り、MoE アーキテクチャによって推論時には 44B パラメータが活性化されます(256 エキスパート中 8 エキスパートを選択)。DeepSeek の Sparse Attention メカニズム (DSA) を取り入れており、長大なコンテキストを効率的に処理する能力に優れています。

Kiro での仕様は以下の通りです。

- コンテキストウィンドウ: 200,000 トークン

- クレジット乗数: 0.5x

- 対応リージョン: US East (N. Virginia)

GLM-5 の特長は、リポジトリ規模のコンテキストを一括処理しながら、複数ステップにわたるツール呼び出しの一貫性を維持する能力にあります。200K トークンのコンテキストウィンドウは、大規模なモノリポや複数マイクロサービスにまたがる変更を一度のセッションで扱う場合に特に力を発揮します。

モデルのトレーニングは Reasoning RL → Agentic RL → General RL という段階的な強化学習パイプラインで行われており、複雑な推論と長期的なエージェント動作の両立を実現しています。アーキテクチャの大規模変更、長期にわたるエージェントワークフロー、そして数万行規模のリファクタリングといったユースケースに対して、コンテキストを失わずに継続的に作業できる点が開発者から高く評価されています。

IDE と CLI からすぐに使い始める方法

MiniMax M2.5 と GLM-5 はいずれも、Kiro IDE のモデルセレクターおよび Kiro CLI から利用可能です。特別な設定や追加の資格情報は必要なく、既存の Kiro ワークスペースからそのままアクセスできます。

IDE から利用する場合は、Kiro IDE を最新バージョンに更新(または再起動)することで、モデルセレクターに MiniMax M2.5 および GLM-5 が表示されます。チャットウィンドウやエージェントモードのモデル選択ドロップダウンから切り替えるだけで、すぐに利用を開始できます。

CLI から利用する場合は、kiro コマンドでモデルを指定して実行できます。スクリプトや CI/CD パイプラインに組み込む際にも、フラグでモデルを明示するだけで切り替えが完了します。

モデルの推論は Amazon Bedrock を通じて提供されており、MiniMax M2.5 は US East と EU Frankfurt の2リージョンで、GLM-5 は US East でそれぞれ利用可能です。AWS IAM Identity Center での認証環境であれば、Bedrock 側での追加設定なしに Kiro から透過的にアクセスできます。

活用シナリオ別の使い分けガイド

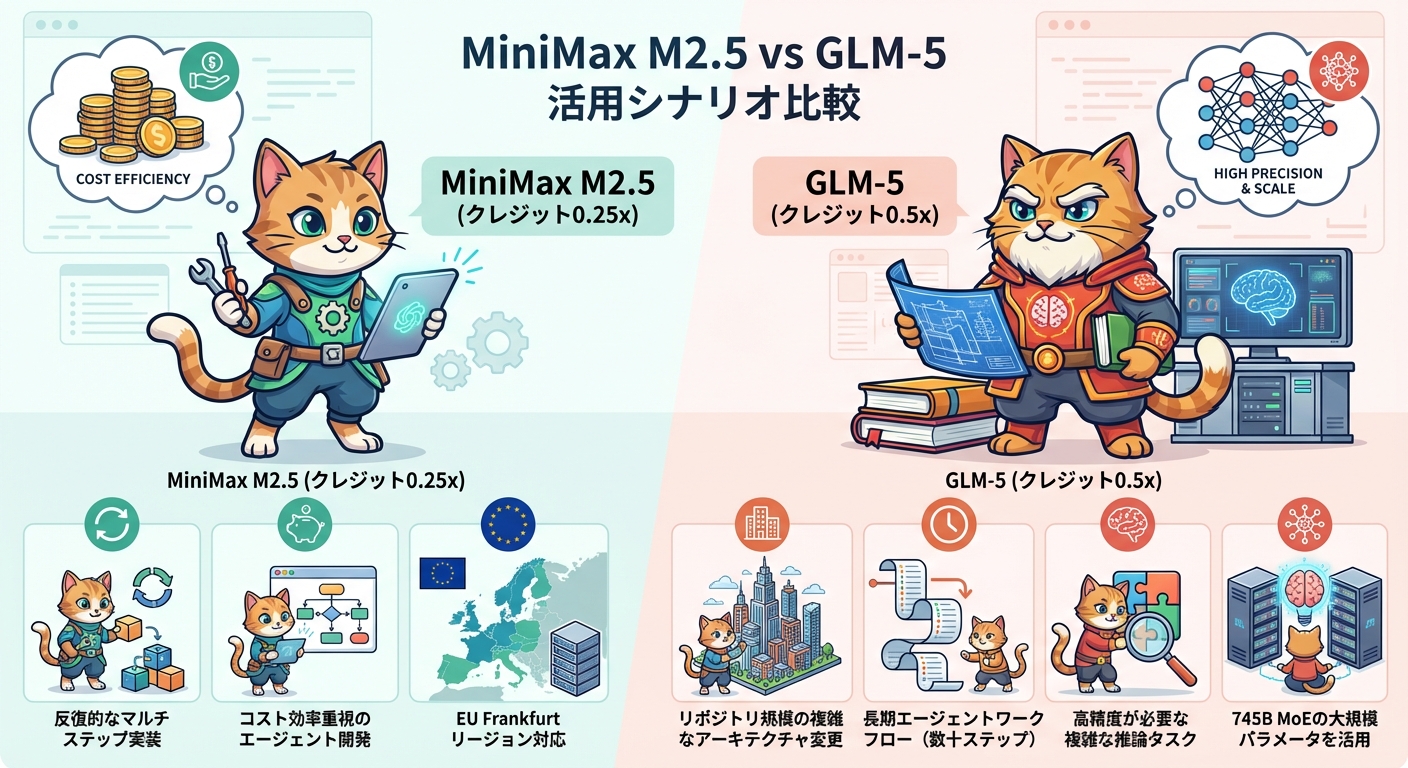

2つのモデルはどちらも優れたエージェント対応モデルですが、得意とするユースケースに違いがあります。実務での使い分けの指針を整理します。

MiniMax M2.5 が向いているシナリオ

コスト効率重視のエージェント開発 — 0.25x という低クレジット乗数は、長時間のエージェントセッションを頻繁に走らせる場面で圧倒的なコスト優位性をもたらします。SWE-Bench 80.2% という実績が示す通り、バグ修正・テスト自動生成・機能実装といったコーディングタスクの自律実行に適しています。

反復的なマルチステップ実装 — 「仕様書を読み込んで実装し、テストを書いて確認する」というサイクルを繰り返すフローでは、MiniMax M2.5 のコスト効率と速度が特に活きます。数十万の実環境で訓練されているため、現実の開発タスクに対して高い汎化性能を発揮します。

EU リージョンが必要な場合 — EU (Frankfurt) リージョンで利用可能なオープンウェイトモデルの一つであるため、データローカリゼーション要件がある場合にも対応できます。

GLM-5 が向いているシナリオ

リポジトリ規模の複雑なアーキテクチャ変更 — 複数のサービスにまたがるインターフェース変更やデータモデルのリファクタリングは、広範なコードベースへの深い理解が必要です。GLM-5 の 200K コンテキストと大規模 MoE アーキテクチャは、こうした長期的・広範囲な変更作業に特に向いています。

長期エージェントワークフロー — 数十ステップにわたるツール呼び出しを伴う複雑なエージェントタスクでは、コンテキストの一貫性維持が重要です。GLM-5 の Agentic RL トレーニングにより、長いワークフローを通じて計画を維持する能力が強化されています。

高精度が求められる複雑な推論 — 数学的証明、複雑なアルゴリズム設計、多段階の依存関係を持つシステム設計など、深い推論能力が必要なタスクでは GLM-5 の大規模パラメータが威力を発揮します。

選択の指針まとめ

観点 | MiniMax M2.5 | GLM-5 |

|---|---|---|

クレジット乗数 | 0.25x(最低コスト) | 0.5x |

コンテキスト | 200K | 200K |

得意領域 | コーディング・エージェント | 複雑なシステム設計・長期ワークフロー |

対応リージョン | US East / EU Frankfurt | US East のみ |

パラメータ規模 | 230B MoE(10B active) | 745B MoE(44B active) |

Kiro の無料ティアから試せるため、まずは MiniMax M2.5 で日常的なコーディングタスクを試し、大規模リポジトリへの適用や複雑な設計作業が必要になったタイミングで GLM-5 を検討するというアプローチが実践的です。オープンウェイトモデルの採用が広がる中、Kiro はこれらのモデルをフロンティアモデルと同等の UX で利用できる環境を提供しており、エージェント開発のコスト構造を大きく変える可能性を持っています。