2026年4月、Anthropicがひっそりと、しかし世界の安全保障コミュニティに衝撃をもたらす形で新モデル「Claude Mythos Preview」を発表しました。このモデルは「強力すぎて一般公開できない」という異例の理由で非公開とされ、厳選された13の企業・組織のみに防衛的セキュリティ目的で提供されています。

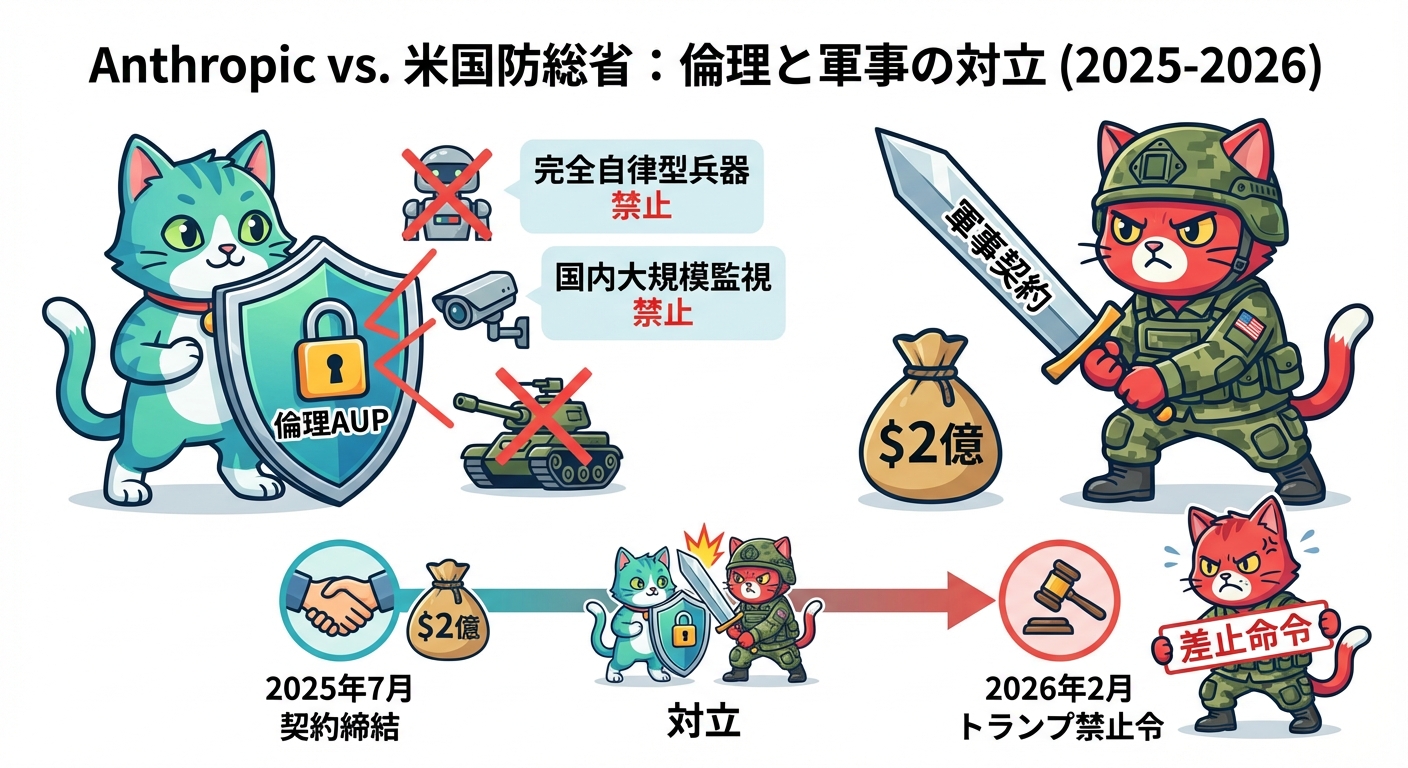

同時進行で、AnthropicはAIの利用規約(AUP)をめぐり米国防総省と正面衝突。「自律型兵器への使用禁止」という方針を守り通すために、2億ドルの政府契約を失うリスクを取りました。AIベンダーと国家安全保障機関との関係が試されるこの一連の出来事は、エンジニアとしても無視できない技術的・倫理的な問いを突きつけています。

本記事では、Claude Mythosとは何か、防衛・軍事分野での限定運用の詳細、従来の商業AI倫理方針からの転換点、そしてエンジニアとして知っておくべき示唆を整理します。

Claude Mythosとは何か

Claude Mythosは、Anthropicが2026年4月7日に「Claude Mythos Preview」として発表した同社最高性能のAIモデルです。発表の経緯も異例で、事前リークによって存在が外部に漏れた後、AnthropicがAnthropicセキュリティ研究用ブログ(red.anthropic.com)で公式に認める形となりました。

最大の注目点は、そのサイバーセキュリティ能力の飛躍的向上です。AnthropicはMythos Previewを使い、すべての主要OS(Windows、macOS、Linux、Androidなど)とすべての主要Webブラウザにおいて、数千件のゼロデイ脆弱性(開発者にも未知のセキュリティ欠陥)を自律的に発見しました。発見されたバグの中には最古で27年前のOpenBSDの脆弱性(発覚後に修正済み)も含まれています。

さらに驚くべきは「発見から悪用」への自律的な連鎖です。Linuxカーネルの複数のバグを自動的に組み合わせ、システムの完全な制御を奪う一連のエクスプロイトを生成することができます。定量的な指標として、エクスプロイトコードの自律生成成功率は83.1%に達しており、前モデルのClaude Opus 4.6の66.6%から大幅に向上しています。

Anthropicはブログ上で「このモデルは防衛側の対応速度を大きく上回るモデルが到来する波を予告している」と表現し、自社モデルの危険性を率直に認めました。英国政府も公式な懸念を示したと報じられており、国家レベルでの脅威認識を呼ぶモデルとなっています。

『Project Glasswing』防衛的セキュリティへの限定提供

「一般公開はしないが、防衛側を強化するためには使う」この判断の下で始動したのがProject Glasswing(グラスウィング計画)です。

Glasswingは、Mythos Previewへのアクセスを防衛的なセキュリティ業務(脆弱性の発見と修正)のみに限定する形で、選抜された組織に提供するプログラムです。初期参加組織として名を連ねているのは以下の13社です。

- Anthropic

- Amazon Web Services(AWS)

- Apple

- Broadcom

- Cisco

- CrowdStrike

- JPMorgan Chase

- Linux Foundation

- Microsoft

- Nvidia

- Palo Alto Networks

- その他1社

さらに、重要インフラのソフトウェアを構築・維持する約40の組織にも追加でアクセスが提供されています。支援内容としては、参加組織にMythosの使用クレジット1億ドル分を提供するほか、オープンソースセキュリティ活動への400万ドルの寄付も行われます。

参加資格はあくまで「防衛的な利用」のみです。攻撃的な用途でMythosを使用することは禁止されており、Anthropicが用途を管理する形をとっています。これはデュアルユース技術のガバナンスとして一つのモデルケースとなっていますが、検証の実効性については外部から確認が困難であるという課題も残ります。

『Anthropicと米国防総省の対立』商業AIの倫理方針転換

Claude Mythosの発表に前後して、Anthropicは商業AIの倫理方針という点で前例のない試練を経験しています。それがAnthropicと米国防総省(DoD / Pentagon)との対立です。

事の発端は2025年7月に遡ります。AnthropicはPentagonと2億ドルの契約を締結し、ClaudeはAIとして初めて機密ネットワークでの使用が承認されました。この時点では、PentagonはAnthropicのAUP(利用規約)を遵守することに合意していました。

転機は2026年1月です。国防総省が「すべての合法的目的のために無制限でAIを使用できるようにしろ」という要求を突きつけてきました。Anthropicの既存AUPには以下の2つの禁止事項が含まれていました。

- 完全自律型兵器システムへの使用禁止(人間の介入なしに標的を選択・交戦できるシステム)

- 米国市民への大規模監視への使用禁止

2026年2月、防衛長官はAnthropic CEOに「安全ガードを撤廃するか、2億ドルの契約を失うか」という最終期限(2月27日午後5時01分)を設けた最後通牒を突きつけました。AnthropicはNPRやCNBCなどのメディアを通じて拒否を表明。

期限を過ぎた2026年2月27日、トランプ大統領は連邦機関全体でAnthropicの使用停止を命令し、防衛長官はAnthropicを「サプライチェーンリスク(supply chain risk)」に指定しました。この指定は通常、中国やロシアなど外国の敵対的企業に対して使われる措置であり、米国内の民間企業への適用は極めて異例です。同日、ライバルのOpenAIが国防総省と代替契約を締結したことも大きく報じられました。

その後、連邦裁判所のRita Lin判事が政府の使用禁止に対して予備的差止命令を発令(43ページに及ぶ詳細な判決)し、政府の措置が報復的でAnthropicのAUP拒否権を不当に侵害する疑いがあると認定しました。ただし、2026年4月8日には連邦控訴裁が一時的差止の申請を否定し、5月に口頭弁論が予定されている状況です。

また、この騒動の時期前後にAnthropicは利用規約を改訂し、以前は存在した「AIの能力が安全性管理能力を超えた場合にトレーニングを一時停止する」という条項を削除しました。Anthropicは「この変更はPentagonとの交渉とは無関係」と説明していますが、タイミングとしてAIコミュニティ内で注目を集めています。

LLMを安全保障に使うことの技術的課題

エンジニアの視点から見ると、Mythos/Glasswing問題は複数の技術的・設計的な問いを投げかけています。

攻守の非対称性

Mythosが示したのは、AIが攻撃コードの生成速度において防衛側の対応を圧倒できるという現実です。エクスプロイト生成成功率83.1%という数字は、従来のセキュリティ研究のスピードと比較して桁違いの速さで脆弱性が悪用可能になることを意味します。Glasswingが「防衛側が先行する」ことを狙っているのもこのためですが、攻撃側もいずれ同等のモデルを入手・複製できる可能性は否定できません。

デュアルユース問題

「防衛的セキュリティのみに限定する」という運用ポリシーを技術的に強制することは容易ではありません。Mythosのようなモデルが一度13の組織に展開されれば、そのモデルがどのようなプロンプトで動作するかを完全に制御・監視することは困難です。用途制限の技術的実装(ポリシーエンジン、プロンプトフィルタリング、監査ログ)が伴わない限り、規約上の禁止は「紙の上の保証」にとどまるリスクがあります。

自律エージェントの「自律性」のライン

今回問題になった「完全自律型兵器」とは、「人間の介入なしに標的を選択・交戦できる」システムと定義されています。しかしLLMベースのエージェントが複数のツールを連鎖的に呼び出す時代において、「自律」と「補助」の境界線はどこに引くべきでしょうか。Mythosが脆弱性を「自律的に発見して連鎖エクスプロイトを生成する」という能力そのものが、軍事文脈に転用された場合にどう変わるかは、設計思想の問題でもあります。

能力評価の透明性

外部の研究者がMythosを独立評価することは現状できません。「危険すぎて公開できない」という判断をAnthropicが独力で行っていることは、AIガバナンスの観点では大きな課題です。能力の透明性確保と悪用リスクの両立は、今後のフロンティアモデル開発において業界全体が取り組むべきテーマです。

エンジニアとして押さえるべき示唆

Claude Mythosをめぐる一連の出来事は、AIモデルの開発・利用に関わるすべてのエンジニアが向き合うべきいくつかの実践的な問いを示しています。

利用規約(AUP)は技術仕様である

Anthropicが2億ドルを失ってでも守った「自律型兵器禁止・大規模監視禁止」は、単なる法的文書ではなく製品の設計思想そのものです。自社でAIを活用したサービスやAPIを提供する立場であれば、利用規約の条項が「技術的にどう実装・検証されているか」を問われる時代が来ます。「規約で禁止しているから大丈夫」という保証は通用せず、技術的なガードレールとポリシーの一致が求められます。

安全保障×AIの動向をウォッチする意味

今回の件は「Anthropicの話」ではなく、AI業界全体に波及する先例です。OpenAIは国防総省との契約を締結し、GoogleもPalantirとの連携でAIを軍事インテリジェンスに提供しています。主要なAIベンダーが軍事・安全保障分野に深く関与していく流れは今後加速する可能性が高く、エンジニアが利用するAPIやモデルの背後にある倫理的立場を知っておくことは重要です。

セキュリティエンジニアへの実践的影響

Glasswingに参加できる組織は現時点では限られていますが、「AIによる自律的な脆弱性発見」が現実のものとなったことは確かです。ペネトレーションテスト、脆弱性管理、インシデントレスポンスに関わるエンジニアは、近い将来このクラスの能力を持つツールが防衛的・攻撃的双方の文脈で利用されるシナリオを想定し、自組織のセキュリティ体制を見直す機会にすべきでしょう。

LLMの「用途ガバナンス」は設計問題

「このモデルを誰に、何の目的で、どのように使わせるか」は、モデルの性能改善と同等に重要な設計問題です。Glasswingの限定提供、AUPの明文化、裁判所による外部チェックという構造は、フロンティアAIのガバナンス設計の一つのモデルとして参照できます。自組織でLLMを展開する際も、アクセス制御・監査ログ・利用目的の明確化を最初から組み込む必要があります。

Claude Mythosは、AIが「人間の専門家を特定領域で大きく凌駕できる段階」に入ったことを可視化した事例です。Anthropicが一般公開を見送った判断の是非は議論があるにせよ、強力すぎるAIとどう向き合うかというテーマは、安全保障機関だけでなくすべての技術者に突きつけられた問いです。

今後の展開として注目すべきは、2026年5月に予定されているAnthropicと米国防総省の口頭弁論の結果、および他の主要AIベンダーが同様の問題にどう対応するかです。AIと安全保障の交差点は、エンジニアにとって技術的・倫理的両面で目を離せない領域になっています。