「AIが嘘をつく」問題にどう向き合うか

.jpg)

生成AIは驚くほど自然な文章を生成しますが、時として事実と異なる情報を、あたかも正確であるかのように出力することがあります。これがハルシネーション(幻覚)と呼ばれる現象です。

業務で生成AIを活用する際、このハルシネーションへの対処は避けて通れない課題です。誤った情報に基づいて意思決定を行えば、ビジネスに深刻な影響を及ぼす可能性があります。

本レポートでは、Ragate株式会社が2025年12月に実施した505名への独自調査から、ハルシネーションに対する企業の認識と具体的な対策手法を詳しく解説します。

調査概要

本調査は以下の条件で実施しました。

- 調査期間:2025年12月11日〜

- 調査方法:インターネットリサーチ

- 有効回答数:505名

- 調査対象:日本国内のビジネスパーソン(情報システム部門・DX推進室所属者)

ハルシネーションへの懸念:35.2%が課題認識

.jpg)

課題としての位置づけ

調査結果から、生成AI導入における課題として「出力精度の不確実性(ハルシネーション)」は35.2%で第2位にランクインしています。

課題 | 回答率 | 順位 |

|---|---|---|

情報漏洩・セキュリティリスク | 42.2% | 1位 |

出力精度の不確実性(ハルシネーション) | 35.2% | 2位 |

著作権・コンプライアンス懸念 | 28.3% | 3位 |

従業員のスキル不足 | 24.9% | 4位 |

ガイドライン整備の遅れ | 19.4% | 5位 |

約3社に1社がハルシネーションを課題として認識しており、セキュリティに次ぐ重要課題となっています。

ハルシネーションとは何か

.jpg)

発生メカニズム

ハルシネーションとは、生成AIが事実に基づかない情報を、あたかも正確な情報であるかのように出力する現象です。

なぜ発生するのか

学習データの限界

- 学習データに含まれていない情報は「推測」で補完される

- 学習データ自体に誤りが含まれている場合がある

言語モデルの特性

- 「もっともらしい文章を生成する」ことが目的

- 「正確な情報を出力する」ことは保証されていない

文脈理解の限界

- 複雑な文脈や専門的な内容で精度が低下

- 最新情報には対応できない(学習カットオフ以降)

ハルシネーションの具体例

カテゴリ | 具体例 |

|---|---|

事実の誤り | 存在しない法律や規制を「ある」と回答 |

数値の誤り | 統計データを誤った数値で提示 |

出典の捏造 | 実在しない論文や文献を引用 |

時系列の誤り | 過去の情報を最新の情報として提示 |

因果関係の誤り | 相関と因果を混同した説明 |

業務領域別のハルシネーションリスク

.jpg)

リスクマトリクス

業務領域によってハルシネーションのリスクと影響度は異なります。

活用領域 | 活用率 | ハルシネーションリスク | 影響度 |

|---|---|---|---|

情報収集・調査・分析 | 39.2% | 高 | 高 |

システム開発・運用 | 37.4% | 中 | 中〜高 |

コンテンツ作成・編集 | 30.9% | 中 | 中 |

議事録作成・要約 | 28.1% | 低 | 低〜中 |

社内問い合わせ対応 | 26.5% | 中 | 中〜高 |

高リスク領域:情報収集・調査・分析

活用率39.2%で最多の「情報収集・調査・分析」は、ハルシネーションの影響を最も受けやすい領域です。誤った市場データや競合情報に基づいて意思決定を行えば、ビジネスに直接的な損害を与える可能性があります。

中リスク領域:システム開発・運用

システム開発領域(37.4%)では、AIが生成したコードにバグが含まれる、または非効率な実装が行われるリスクがあります。人間によるコードレビューが必須です。

比較的低リスク領域:議事録作成・要約

議事録作成・要約(28.1%)は、元となる会議音声や文書が存在するため、ハルシネーションのリスクは相対的に低くなります。ただし、要約時の情報の取捨選択に偏りが生じる可能性はあります。

ハルシネーション対策の5つのアプローチ

アプローチ1:RAG(検索拡張生成)の導入

最も効果的な対策がRAG(Retrieval-Augmented Generation)です。社内のナレッジベースや信頼できる情報源と連携させることで、ハルシネーションを大幅に低減できます。

RAGの仕組み

- ユーザーの質問を受け取る

- 関連する社内文書やデータを検索

- 検索結果を文脈としてLLMに渡す

- LLMが検索結果に基づいて回答を生成

RAGのメリット

- 回答の根拠が明確になる

- 社内情報に基づいた正確な回答が可能

- 出典を提示できるため検証が容易

- 最新情報にも対応可能

導入ツール

調査データではDify(5.5%)が注目されています。DifyはノーコードでRAG環境を構築でき、Amazon Bedrockとの連携も容易です。

アプローチ2:ファクトチェック体制の構築

人間によるファクトチェックプロセスを組み込むことが重要です。

ファクトチェックフロー

ステップ | 内容 |

|---|---|

1. AI出力 | 生成AIが回答を生成 |

2. 自動検証 | 明らかな誤りをルールベースで検出 |

3. 人間レビュー | 担当者が内容を確認 |

4. 必要に応じて修正 | 誤りがあれば修正・補足 |

5. 承認・公開 | 品質確認後に利用可能に |

業務領域別のチェック強度

領域 | 推奨チェック強度 |

|---|---|

社外公開コンテンツ | 必須・厳格 |

経営判断の材料 | 必須・厳格 |

社内報告資料 | 必須・標準 |

業務メモ・下書き | 推奨・簡易 |

ブレインストーミング | 任意 |

アプローチ3:プロンプトエンジニアリングの最適化

プロンプトの設計によってハルシネーションを低減できます。

効果的なプロンプト設計

明確な指示

- 曖昧な質問を避け、具体的に指示

- 回答形式(箇条書き、表形式等)を指定

制約条件の明示

- 「分からない場合は『分かりません』と回答してください」

- 「推測は含めず、確実な情報のみ回答してください」

出典の要求

- 「回答の根拠となる情報源を明記してください」

- 「引用元のURLや文書名を記載してください」

信頼度の表明

- 「回答の確信度を0〜100%で示してください」

- 「不確かな部分には【要確認】と記載してください」

プロンプト例

以下の質問に回答してください。

【質問】

〇〇について教えてください。

【回答条件】

- 確実な情報のみ回答し、推測は含めないでください

- 分からない場合は「分かりません」と回答してください

- 回答の情報源があれば明記してください

- 不確かな部分には【要確認】と記載してくださいアプローチ4:用途に応じたモデル選定

用途によって最適なLLMモデルは異なります。

用途 | 推奨モデル傾向 | 理由 |

|---|---|---|

事実確認重視 | 最新の大規模モデル | 知識量と推論能力 |

コスト重視 | 軽量モデル | 低コストで高速 |

日本語重視 | 日本語特化モデル | 日本語の精度 |

専門領域 | ファインチューニング済 | 専門知識の精度 |

アプローチ5:継続的なモニタリングと改善

ハルシネーションの発生状況を継続的にモニタリングし、改善サイクルを回すことが重要です。

モニタリング指標

指標 | 測定方法 |

|---|---|

ハルシネーション発生率 | 抽出サンプルの人手検証 |

ユーザーからの指摘件数 | フィードバック収集 |

ファクトチェックでの修正率 | レビュープロセスでの集計 |

出典明示率 | 回答に出典が含まれる割合 |

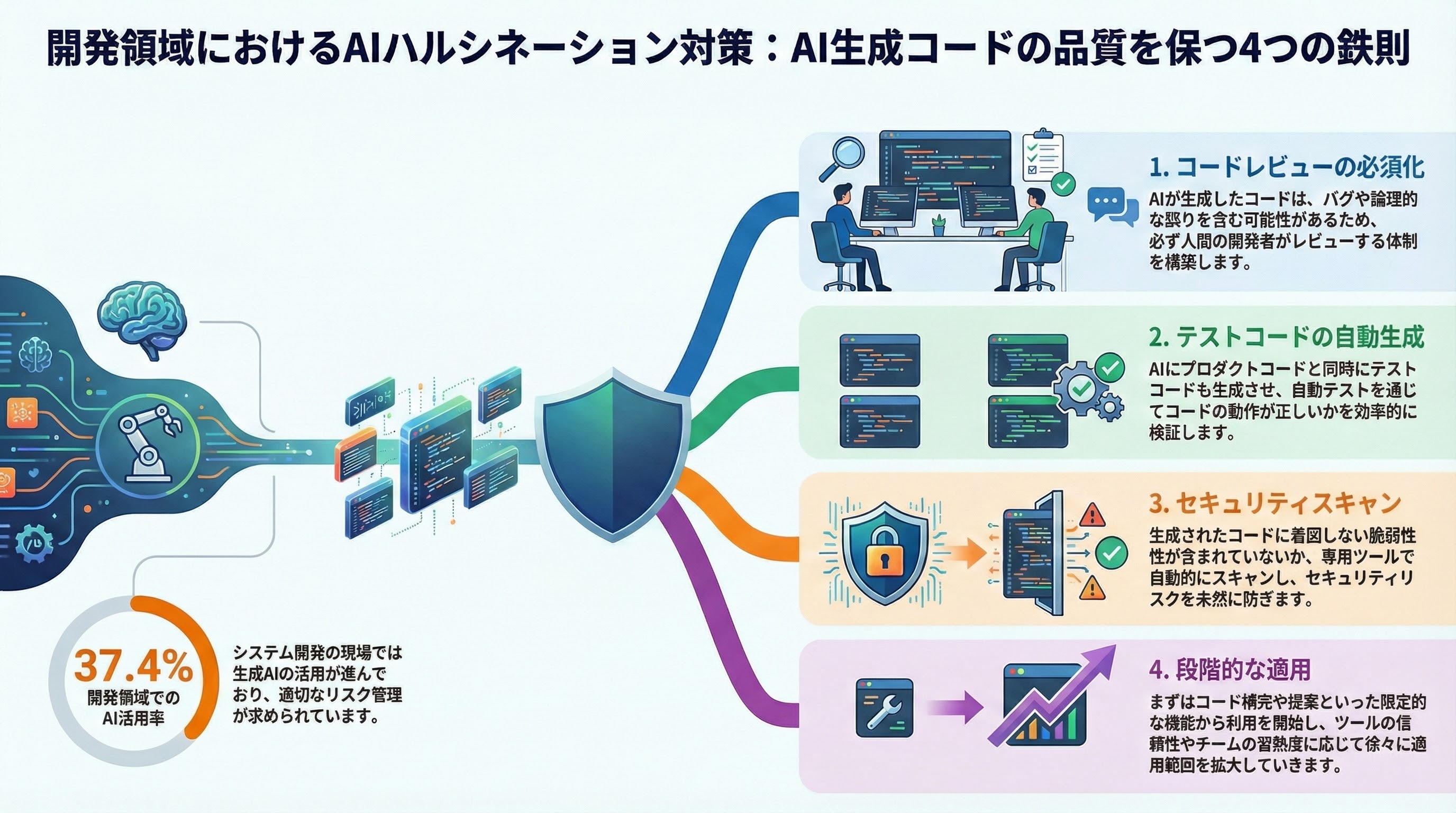

開発領域でのハルシネーション対策

コード生成における注意点

システム開発領域(活用率37.4%)では、以下の対策が有効です。

1. コードレビューの必須化

AI生成コードは必ず人間がレビューする体制を構築。

2. テストコードの自動生成

AI生成コードに対して、テストコードも同時に生成させ、動作検証を行う。

3. セキュリティスキャン

生成コードに脆弱性がないかを自動スキャン。

4. 段階的な適用

- 最初はコード補完・提案のみに活用

- 実績を積んでから適用範囲を拡大

まとめ

本調査により、以下の点が明らかになりました。

- 35.2%がハルシネーションを課題として認識し、セキュリティに次ぐ重要課題

- 情報収集・調査領域(39.2%)が最もリスクが高い活用領域

- RAG導入が最も効果的な対策であり、Difyなどのツールで構築可能

- 人間によるファクトチェック体制は引き続き必須

- プロンプト設計の最適化でもリスク低減が可能

ハルシネーションを完全にゼロにすることは困難ですが、適切な対策を講じることで、リスクを許容範囲内にコントロールすることは可能です。本レポートの内容を参考に、安全な生成AI活用を実現してください。

ハルシネーション対策でお悩みの方へ

「RAG環境を構築したいが、方法が分からない」「社内ナレッジを活用した信頼性の高いAIチャットボットを作りたい」——そのようなお悩みをお持ちではありませんか?

Ragate株式会社では、Difyを活用したRAG環境の構築から、Amazon Bedrockとの連携、AWS上でのセキュアなホスティングまで一気通貫で支援いたします。社内文書やFAQに基づいた、ハルシネーションを低減した信頼性の高いAIシステムを構築します。

また、生成AIの品質管理を含むAX(AI Transformation)全体の設計をご希望の方には、AI TRiSMフレームワークに基づいたリスク評価とガバナンス策定も含むコンサルティングをご用意しています。