はじめに!ガートナーが示した「AI推論コスト90%削減」の衝撃

2026年3月、米調査会社ガートナーが発表したレポートは、AI業界に大きな波紋を呼びました。「2030年までに、1兆パラメータを持つLLMの推論コストが2025年比で90%以上削減される」——この予測は、生成AIのコスト構造が根本的に変わることを示唆しています。

さらに驚くべきは、「2022年の同規模モデルと比べると、2030年のLLMは最大100倍のコスト効率を実現する」という見通しです。

しかし、このニュースを「AIがもっと安く使えるようになる」と単純に喜ぶのは早計です。ガートナーは同時に、「処理コストの削減が、そのまま企業のAI活用コスト削減につながるわけではない」という重大な警告を発しています。本記事では、この予測の背景にある技術的要因を解説しながら、企業がAIコストを最適化するための実践的な戦略を紐解いていきます。

なぜ推論コストが劇的に下がるのか——5つの技術的要因

ガートナーのシニアディレクター兼アナリスト、ウィル・ソマー氏は、コスト削減を牽引する要因として次の5つを挙げています。

要因 | 内容 |

|---|---|

半導体・インフラの処理効率向上 | プロセスノードの微細化(3nmへの移行等)により、同じ電力でより多くの計算が可能に |

モデル設計の革新 | 量子化(4bit/8bit)、蒸留(Distillation)、疎性(Sparsity)などの技術による効率化 |

チップ利用率の向上 | 推論ワークロードの最適化スケジューリングにより、GPUのアイドル時間を削減 |

推論特化シリコンの普及 | 汎用GPUではなく推論専用に設計されたチップ(NPU・ASIC)の活用拡大 |

エッジデバイスへの応用 | 特定ユースケースでは端末側で処理することで、クラウド推論コストを回避 |

特に注目すべきは「推論特化シリコン」の台頭です。AWSが独自開発したAWS Inferentia2は、汎用GPU比で推論コストを最大70%削減できると報告されています。2025年12月に発表されたTrainium3は3nmプロセスを採用し、前世代比で電力効率を40%向上させています。これらの専用チップが普及することで、業界全体の推論コストは構造的に低下します。

2つのシナリオ:フロンティア vs レガシーブレンド

ガートナーの予測は、半導体の利用状況に応じて2つのシナリオに分かれています。

フロンティアシナリオは、最先端チップのみを前提としたケースです。このシナリオでは、コスト削減効果が最大化されます。NVIDIAのBlackwellアーキテクチャやAWSのTrainium3など、最新世代の半導体が全面的に展開された環境で実現される推論コストを想定しています。

レガシーブレンドシナリオは、現在市場に流通している多様な世代の半導体が混在する現実的なケースです。このシナリオでも大幅なコスト削減は見込まれますが、フロンティアシナリオと比べると絶対的なコストはかなり高くなります。

企業の現実に照らすと、レガシーブレンドシナリオのほうが実態に近いでしょう。既存のデータセンターや契約済みのクラウドリソースを全て最新世代に刷新することは現実的ではありません。したがって、「90%削減」という数字をそのまま自社のコスト試算に適用することには注意が必要です。

「コストが下がっても企業は得しない」——AIエージェント時代の落とし穴

ガートナー予測の最も重要な示唆は、むしろこちらです。「LLMの処理コストが下がっても、企業が支払うAIコストは増加する可能性が高い」という警告です。

なぜそうなるのか。答えは「AIエージェント」にあります。

従来の生成AIチャットボットが1回のタスクで消費するトークン数を「1」とすると、自律的に複数のツールを呼び出しながら複雑なタスクをこなすAIエージェントは、同じタスクで5〜30倍のトークンを消費します。

ウィル・ソマー氏はCIO Diveのインタビューでこう述べています。「チャットボットからエージェント型アシスタントにアップグレードする場合、単にクエリが増えるというだけでなく、個々のクエリが5〜30倍のトークンコストになる」と。

つまり、トークン単価が下がっても、消費量が爆増することで総コストは上昇する可能性があります。これはAIの活用が「チャットで質問する」から「エージェントが自律的に業務を遂行する」へと進化するほど顕著になります。

AWSを使ったLLMコスト最適化の実践戦略

ガートナーはこの課題に対し、明確な方針を提示しています。「日常的で高頻度なタスクは安価な小規模・ドメイン特化型モデルで処理し、高度で複雑な処理のみに大規模LLMを使うべき」——このアドバイスを、AWSのサービスを活用して実践する方法を見ていきましょう。

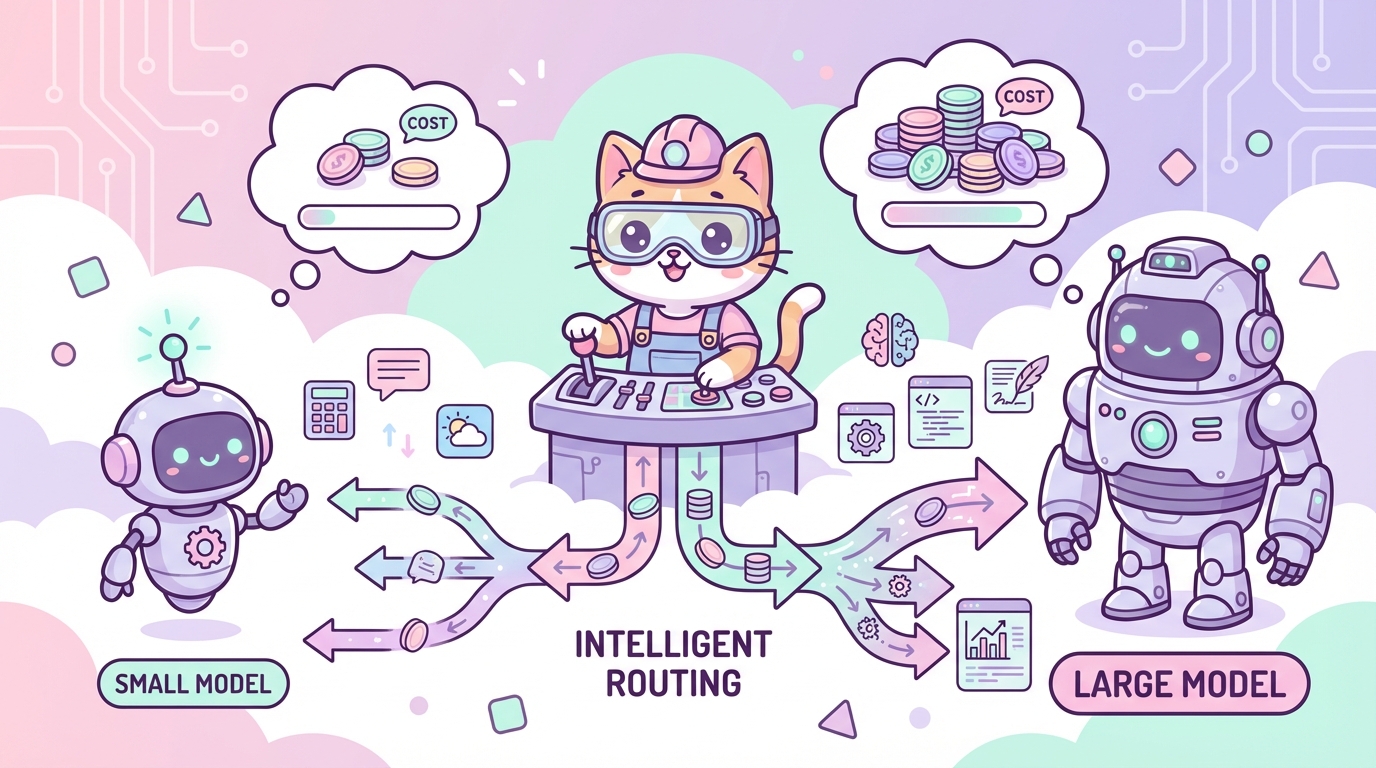

Intelligent Prompt Routing でモデルを自動選択する

Amazon BedrockのIntelligent Prompt Routingは、クエリの複雑さに応じて適切なモデルに自動ルーティングしてくれる機能です。例えば、Claude 3.5 Sonnet(高コスト)とClaude 3 Haiku(低コスト)をプールとして設定すると、シンプルな質問にはHaikuが、複雑な推論が必要な質問にはSonnetが割り当てられます。

AWSの実験では、この機能だけで精度を維持しながらコストを最大30%削減できることが確認されています。ある金融犯罪捜査エージェントの事例では、マルチモデル戦略とIntelligent Prompt Routingの組み合わせにより、1日5億件から50億件へとスケールしながら80%のコスト削減を達成しています。

Model Distillation で小型モデルをカスタマイズする

大規模モデル(Teacher)の知識を小規模モデル(Student)に転移させるModel Distillationも強力な手段です。Amazon Bedrockのモデル蒸留機能を活用すると、元のモデルと比べて最大500%高速で最大75%低コストな専用モデルを作れます。しかも精度損失は2%未満というケースもあります。

特定のドメイン(例:法律文書の要約、サポート対応の分類)に特化したユースケースであれば、大規模モデルに匹敵する精度を維持しながら大幅なコスト削減が実現できます。

Prompt Caching でトークンコストを最大90%削減する

同じプロンプトのプレフィックスを繰り返し使用するアプリケーション(ドキュメントQ&A、コーディングアシスタントなど)では、プロンプトキャッシングが非常に有効です。一度処理したプロンプト部分をキャッシュすることで、再計算を省略でき、入力トークンのコストを最大90%削減できます。

推論特化シリコン(AWS Inferentia)を活用する

自社でモデルをホスティングする場合は、AWS Inferentia2搭載のInf2インスタンスを検討する価値があります。同等のEC2インスタンスと比べて40%優れたコストパフォーマンスを発揮します。月々の推論コストが1万ドルを超えるワークロードであれば、移行コストを十分に回収できます。

まとめ,「安くなる」ではなく「賢く使う」時代へ

ガートナーの予測が示すのは、単純な「AIが安くなる」という話ではありません。推論コストの構造的な低下と、AIエージェントによるトークン消費の爆増が同時に起きる「複雑なコスト環境」への移行です。

ウィル・ソマー氏の言葉が印象的です。「コモディティトークンの価格下落を、フロンティアインテリジェンスの民主化と混同してはならない。今日、安価なトークンで非効率なアーキテクチャを覆い隠しているCPOは、明日のエージェント規模化に苦しむことになる」。

企業が生成AIで持続的な競争優位を得るためには、次の戦略が重要です。

- 日常的・高頻度タスクには小規模・ドメイン特化モデルを使う

- 複雑な推論タスクのみに高コストなフロンティアモデルを使う

- Intelligent Prompt RoutingやModel Distillationでコスト最適化を自動化する

- エージェント導入時はトークン消費量の増大を事前に見積もる

AWSのAmazon Bedrockは、これらの戦略を実践するための機能セットを揃えています。コストと品質の最適なバランスを追求することが、AI時代の企業競争力を左右するカギとなるでしょう。

Ragateでは、AWSを活用した生成AIの設計・導入支援を行っています。LLMコスト最適化の具体的な取り組みについてご相談がある方は、ぜひお気軽にお声がけください。