Ollama v0.24.0がもたらすCodex Appネイティブ統合

Ollamaは2026年5月14日にv0.24.0を公開し、OpenAI製のデスクトップAIエージェント「Codex App」とのネイティブ統合を実現しました。これまでローカルLLMをCodex Appのバックエンドに据えるには、OpenAI互換エンドポイントの設定をユーザー自身がCodex Appの設定ファイルに書き込む必要がありました。v0.24.0以降は ollama launch codex-app という単一コマンドで、Ollamaが立ち上げた互換エンドポイントをCodex App側のプロファイルに自動登録できます。手元のmacOSやWindows端末から、Ollamaで管理しているローカルモデルとクラウドモデルの双方をCodex AppのUIで直接呼び出せるようになった点が今回の最大の変更です。

従来のCodex AppはOpenAI公式APIを前提として設計されていました。社内データを外部送信できない環境では選択肢から外れていましたが、Ollamaのローカル実行を介してCodex AppのGUI体験を保ちつつ、推論をオンプレ完結させられるようになりました。コーディングエージェントの導入で頭を悩ませてきたエンタープライズ開発現場にとって、現実的な選択肢が増えた格好です。

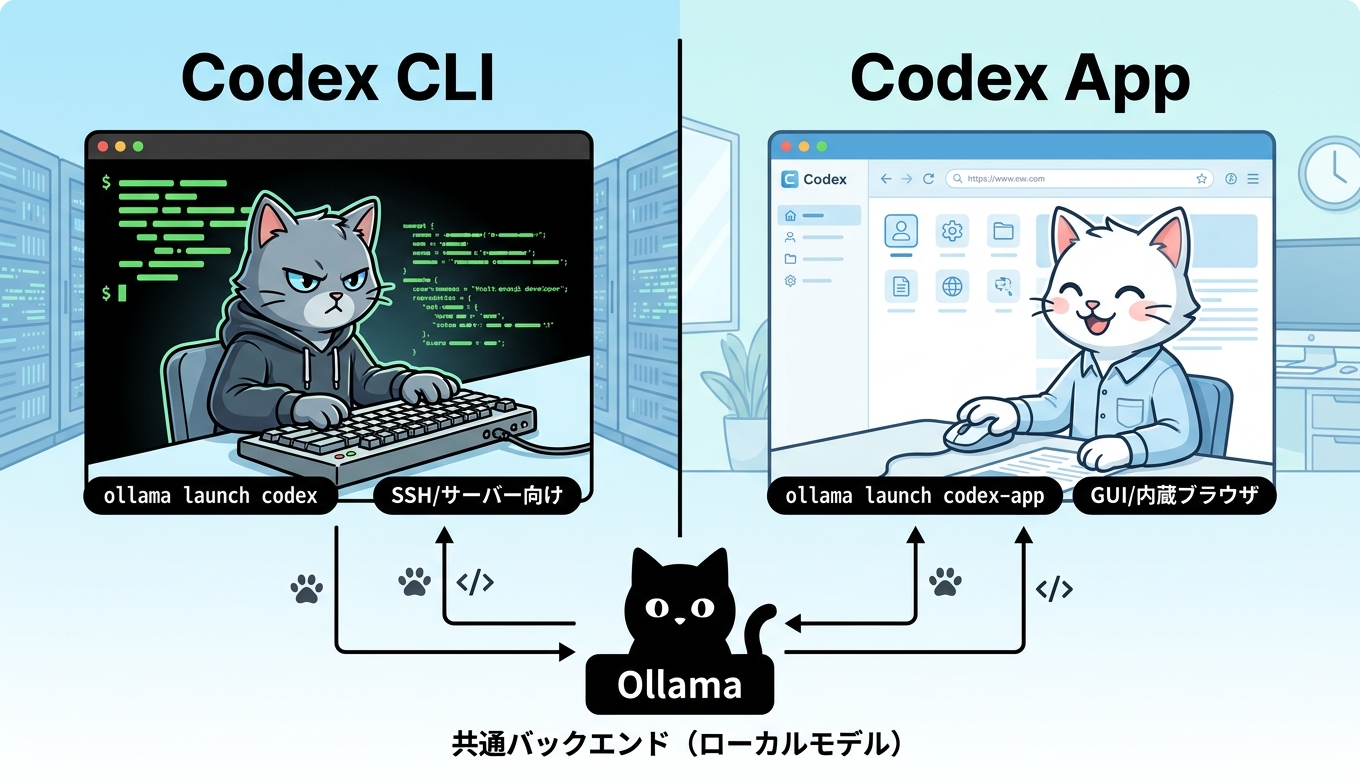

Codex CLIとCodex Appの違いと使い分け

Ollamaのcodex系コマンドは2系統に分かれています。既存の ollama launch codex はターミナルで動作するCodex CLIを起動するもので、サーバーやSSH越しの開発に向きます。新規追加の ollama launch codex-app はmacOS/Windowsのデスクトップアプリ版Codex Appを起動し、内蔵ブラウザやマルチエージェントのGUIを開きます。両者は設定が独立しており、CLIで使うモデル選択とAppで使うモデル選択が干渉しないように分けられています。

切り替え時のバックアップは ~/.ollama/backup/codex-app/ に自動保存され、いつでも巻き戻せます。OpenAIの純正サーバーに戻したいときは ollama launch codex-app --restore を実行すれば、Ollamaが書き換えたCodex App設定を元の状態に戻せます。両コマンドの位置づけを表にまとめます。

項目 | Codex CLI(codex) | Codex App(codex-app) |

|---|---|---|

起動コマンド |

|

|

UI形態 | ターミナル常駐 | GUIデスクトップアプリ |

主要対象 | SSH/サーバー側開発 | ローカル端末でのフロントエンド/全般開発 |

プロファイル | CLI独自プロファイル | App独自プロファイル(CLIと別管理) |

復元コマンド | OpenAI設定の再ログイン |

|

対応モデル ― ローカル実行とクラウドモデルの選択基準

v0.24.0のリリースノートでは、Codex App向けに推奨されるモデルが難易度別に整理されています。難易度の高いタスクには kimi-k2.6(ビジョン対応)や glm-5.1 といったクラウド側の大型モデルが想定されており、Ollama Cloudのサブスクリプションを併用するとUI側でそのまま指定できます。サブスクリプションを持たない場合でも、ローカル実行可能な nemotron-3-super、gemma4:31b、qwen3.6 の3モデルが推奨されており、手元GPUのVRAMやApple SiliconのUnified Memoryに合わせて選べます。

モデルを明示したい場合は ollama launch codex-app --model gemma4:31b のように --model オプションを渡します。フロントエンドの軽量タスクには小型ローカル、ビジョン込みの設計レビューにはkimi-k2.6、という使い分けがしやすくなりました。なお、Codex Appの最低コンテキストウィンドウは64kトークンが推奨されており、4k〜8kしか持たない古い量子化モデルではUIが正常に動かない可能性があります。

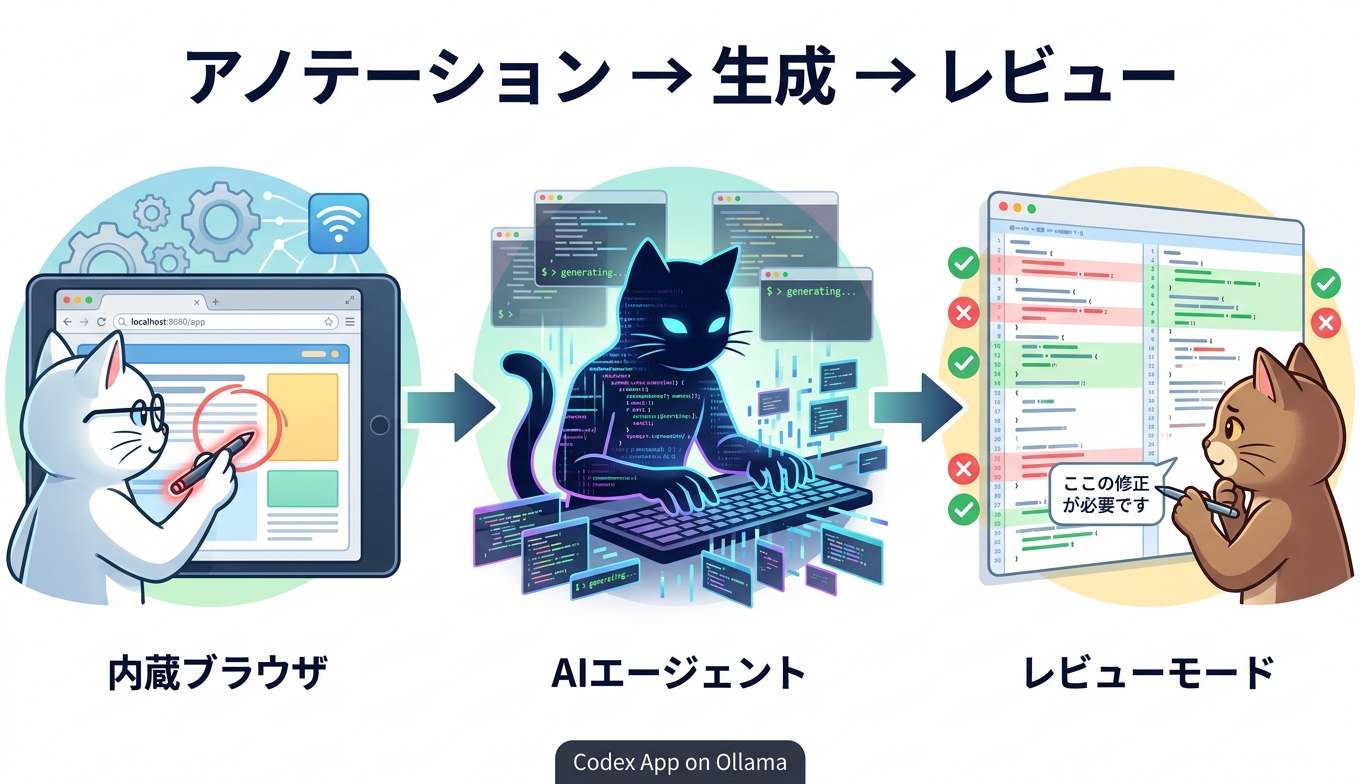

内蔵ブラウザとレビューモードが変えるフロントエンド開発体験

Codex Appの真価は、2026年4月16日のアップデートで強化されたGUI機能群にあります。内蔵ブラウザはローカルサーバーや本番サイトを直接開けるWebViewで、画面上の要素にアノテーションを描くと、その位置情報とともに「ここのボタンを丸くしてホバー時に色を変えて」のような自然言語の指示をCodex本体に渡せます。フロントエンドの修正サイクルでスクリーンショットを撮ってチャットに貼る手間が消えるのは、地味ですが効きます。

レビューモードは、Codex Appを離れずにエージェントが書いた変更をその場で確認、コメント、再修正へとイテレーションできる機構です。コンピューターユース機能と組み合わせると、Mac上のすべてのアプリ(IDE、Figma、ターミナル)をAIが操作しながら、ユーザーは進捗をリアルタイムに監視できます。複数エージェントの並列実行、画像生成(gpt-image-1.5)によるモックアップ作成、Atlassian RovoやCircleCI、GitLab Issuesなど90以上のプラグイン連携、PR対応、SSH接続によるリモートdevbox操作も同じウインドウで完結します。長期タスクを数日〜数週間にわたってスケジュール実行するオートメーション機能も用意されており、これらがすべてOllama経由のローカルモデルで動かせる点がエンタープライズ用途で大きな意味を持ちます。

MLXサンプラー改善とApple Siliconでの恩恵

v0.24.0のもう一つの目玉が、MLXバックエンドのサンプラー改善です。Apple Silicon搭載Macで動作するMLX経由の推論において、サンプリング処理が刷新され、生成の安定性とコード補完時のフォーマット崩れが改善されています。Codex AppはGUIゆえにモデルが返すマークダウンやJSONの形式崩れが目につきやすいため、MLX改善はApp連携と相性のよいアップデートと言えます。

Apple Silicon環境でCodex Appを使う場合、Unified Memoryに余裕があれば gemma4:31b あたりまでが現実的なライン、それより大きいモデルは推論速度の観点でクラウド側のkimi-k2.6に寄せるのが妥当な落としどころです。MLX最適化が効くのは小〜中規模モデルなので、ローカル中心で運用するチームほどMLXの恩恵は大きくなります。

導入手順と運用上の注意点

導入はOllama本体のアップデートから始まります。Homebrewなら brew upgrade ollama、公式インストーラなら ollama.com から最新版を取得し、 ollama --version でv0.24.0以上を確認します。次にCodex Appをインストールし、ターミナルから ollama launch codex-app を実行するとCodex Appの設定がOllama側のローカル/クラウドモデルを向くように書き換わります。利用後にOpenAI純正へ戻すなら --restore を使えば即時に復元できます。

運用面では3点を意識しておくと安全です。まずローカルモデルの選定で、機密度の高いコードは外部送信が発生しないモデル(nemotron-3-superなど)に固定する運用ポリシーを明示します。次にCodex Appの強力なオートメーション機能(数日にわたるスケジュール実行)を導入する場合、誤動作時の被害範囲を限定するため、AIが触れるリポジトリやSSHホストを最初は読み取り専用または検証環境のみに絞ります。最後にバックアップ復元の周知も大切で、業務PCを使い分けるエンジニアごとに --restore の存在を共有しておくと、OpenAI純正環境への切り戻しがスムーズになります。

Ollama v0.24.0は、ローカルLLMの実行基盤に「OpenAIのデスクトップAI開発体験」を接続する役割を担う重要なリリースです。Codex Appをデスクトップ端末で動かしながら推論をローカルに閉じる構成は、これまで両立が難しかった生産性とガバナンスを同時に満たします。手元のmacBookでまず ollama launch codex-app を試し、内蔵ブラウザとレビューモードがチームのワークフローにどう刺さるかを見極めるところから始めてみてはいかがでしょうか。