生成AIと法的リスク——見落とせない課題

生成AIの業務活用が加速する中、「AIが生成したコンテンツの著作権は誰に帰属するのか」「他者の著作物を学習に使用していることは問題ないのか」といった法的な疑問を抱える企業が増えています。

法的リスクへの対応を怠れば、訴訟リスクや企業の信頼失墜につながる可能性があります。一方で、過度に慎重になりすぎてAI活用が進まないのも本末転倒です。

本レポートでは、Ragate株式会社が2025年12月に実施した505名への独自調査から、著作権・コンプライアンスに関する企業の認識とリスク対応の実践手法を詳しく解説します。

調査概要

本調査は以下の条件で実施しました。

- 調査期間:2025年12月11日〜

- 調査方法:インターネットリサーチ

- 有効回答数:505名

- 調査対象:日本国内のビジネスパーソン(情報システム部門・DX推進室所属者)

著作権・コンプライアンス懸念の実態:28.3%が課題認識

.jpg)

課題としての位置づけ

調査結果から、「著作権・コンプライアンスに関する法的懸念」は28.3%で第3位の課題となっています。

課題 | 回答率 | 順位 |

|---|---|---|

情報漏洩・セキュリティリスク | 42.2% | 1位 |

出力精度の不確実性(ハルシネーション) | 35.2% | 2位 |

著作権・コンプライアンス懸念 | 28.3% | 3位 |

従業員のスキル不足 | 24.9% | 4位 |

ガイドライン整備の遅れ | 19.4% | 5位 |

約3社に1社が法的リスクを懸念しており、特にコンテンツ作成業務(活用率30.9%)やクリエイティブ業務(17.2%)で生成AIを活用する企業にとって重要な課題です。

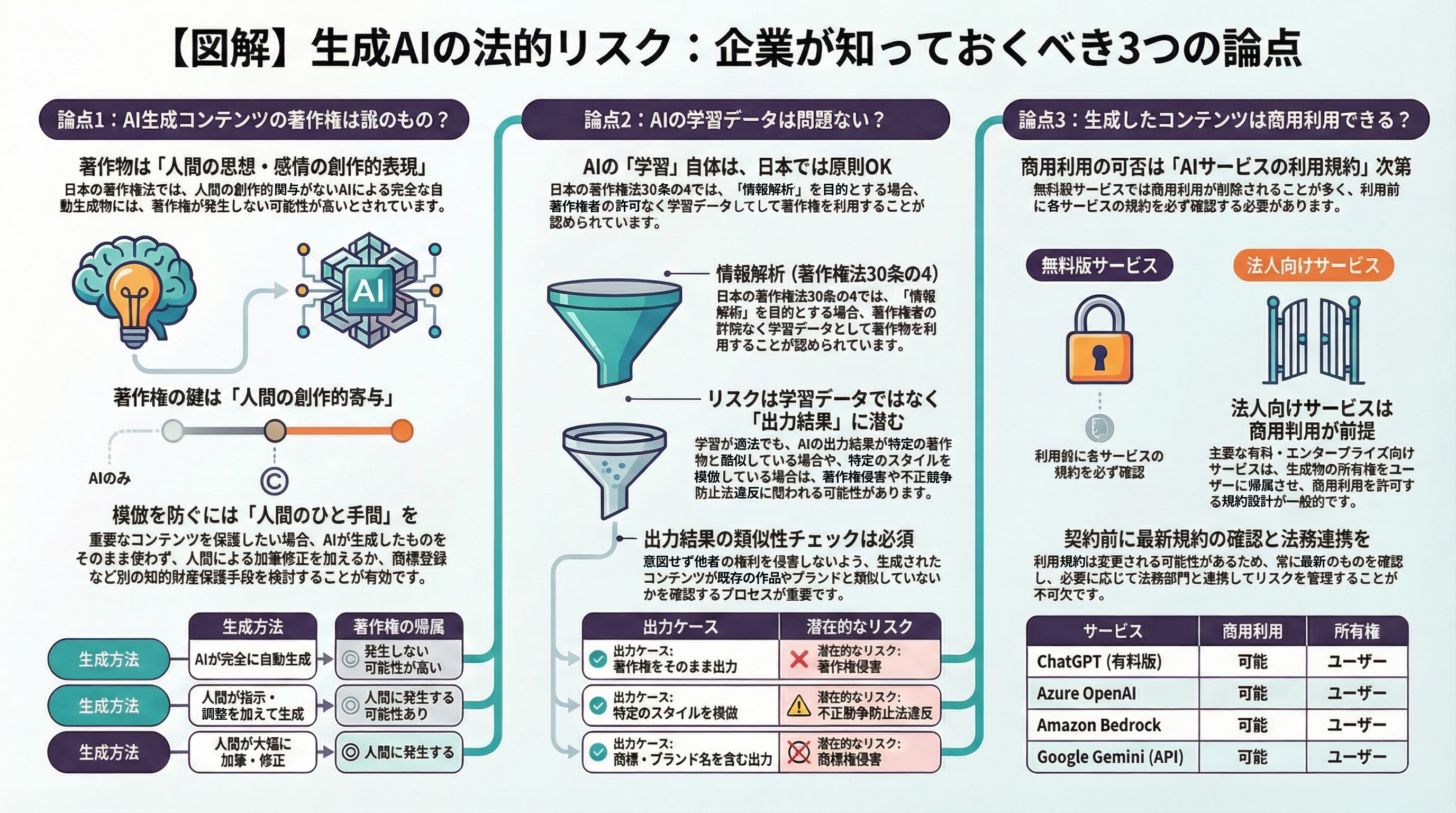

生成AIをめぐる3つの法的論点

論点1:AI生成コンテンツの著作権帰属

問題の所在

生成AIが出力したテキストや画像の著作権は、誰に帰属するのでしょうか。

日本の法的整理(2024年時点)

日本の著作権法では、著作物は「人間の思想または感情を創作的に表現したもの」と定義されています。この定義に照らすと、以下のように整理されます。

生成方法 | 著作権の帰属 |

|---|---|

AIが完全に自動生成 | 著作権は発生しない(可能性が高い) |

人間が指示・調整を加えて生成 | 人間に著作権が発生する(可能性あり) |

人間が大幅に加筆・修正 | 人間に著作権が発生する |

企業への示唆

- AI生成コンテンツをそのまま使用する場合、著作権による保護を受けられない可能性がある

- 競合他社による模倣を防ぎたい場合は、人間による加筆・修正を加えることが望ましい

- 重要なコンテンツは、商標登録など別の知財保護手段も検討

論点2:学習データの著作権問題

問題の所在

生成AIは大量のデータを学習して動作しますが、その学習データには著作権で保護された作品が含まれている可能性があります。

日本の法的整理

日本の著作権法30条の4では、「情報解析」目的での著作物利用について、一定の条件下で著作権者の許諾なく利用できるとしています(権利制限規定)。

ただし、以下のケースでは問題となる可能性があります。

ケース | リスク |

|---|---|

著作物をそのまま出力 | 著作権侵害の可能性 |

特定のスタイルを模倣 | 不正競争防止法違反の可能性 |

商標・ブランド名を含む出力 | 商標権侵害の可能性 |

企業への示唆

- 「学習に使われている」こと自体は、日本では違法とは言い切れない

- ただし、出力結果が既存著作物と類似しないかの確認は必要

- エンタープライズ向けサービス(Azure OpenAI、Bedrock等)では、商用利用に関する保証が提供される場合がある

論点3:AI生成コンテンツの商用利用

問題の所在

AIサービスの利用規約によっては、生成コンテンツの商用利用に制限がある場合があります。

主要サービスの規約(2024年時点の傾向)

サービス | 商用利用 | 所有権 |

|---|---|---|

ChatGPT(有料版) | 可能 | ユーザー |

Azure OpenAI | 可能 | ユーザー |

Amazon Bedrock | 可能 | ユーザー |

Google Gemini(API) | 可能 | ユーザー |

※規約は変更される可能性があるため、利用前に必ず最新の規約を確認してください

企業への示唆

- 無料版サービスの商用利用は制限がある場合が多い

- エンタープライズ向けサービスは商用利用を前提とした規約設計

- 契約前に利用規約を必ず確認し、必要に応じて法務部門と連携

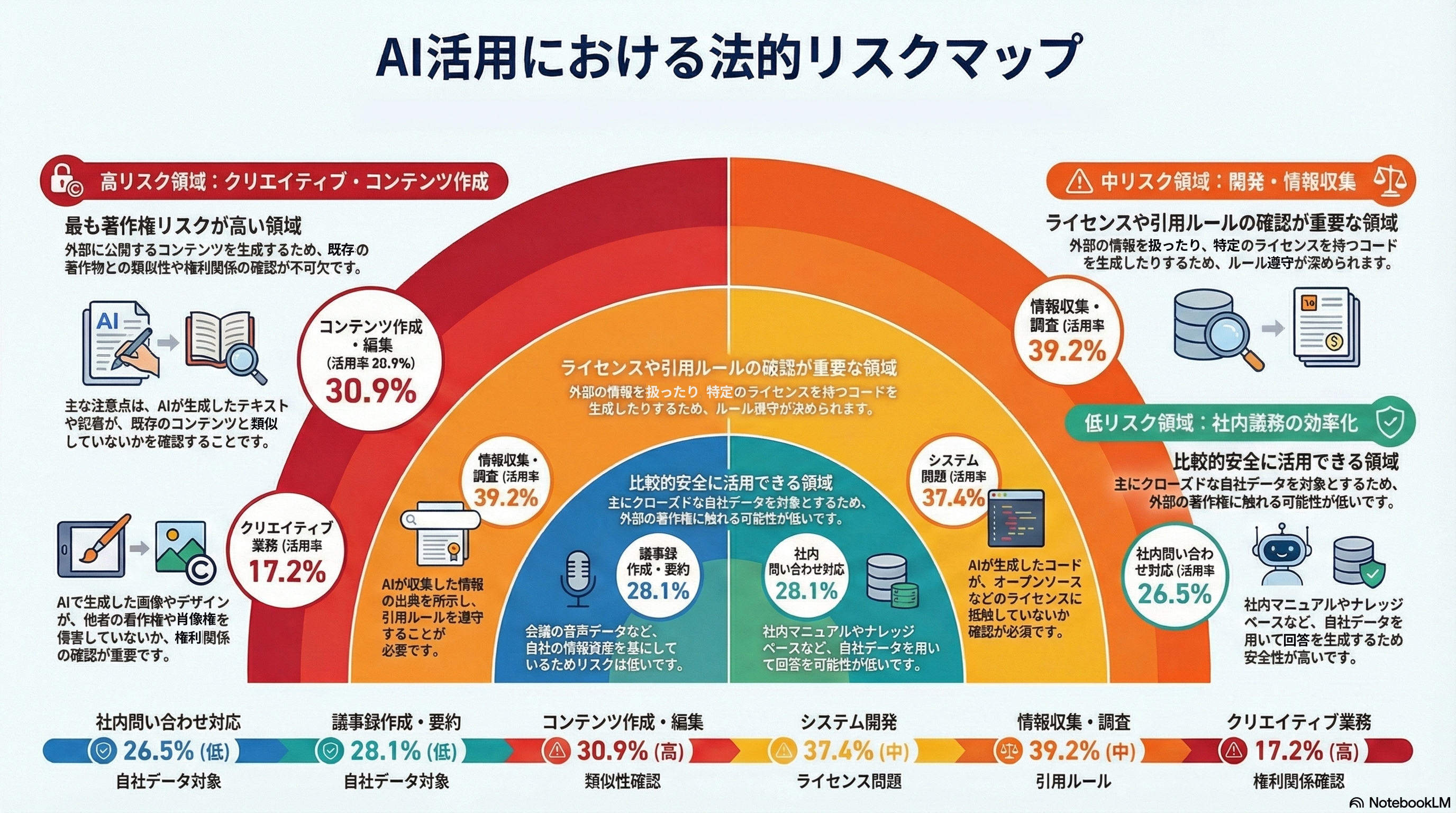

活用領域別の法的リスク

活用領域とリスクの関係

調査で判明した活用領域ごとに、法的リスクの程度を整理します。

活用領域 | 活用率 | 著作権リスク | 主な注意点 |

|---|---|---|---|

コンテンツ作成・編集 | 30.9% | 高 | 既存コンテンツとの類似性 |

クリエイティブ業務 | 17.2% | 高 | 画像・デザインの権利関係 |

情報収集・調査 | 39.2% | 中 | 出典の明示、引用ルール |

システム開発 | 37.4% | 中 | ライセンス問題 |

議事録作成・要約 | 28.1% | 低 | 自社データが対象 |

社内問い合わせ対応 | 26.5% | 低 | 自社データが対象 |

高リスク領域:コンテンツ作成・クリエイティブ

コンテンツ作成(30.9%)とクリエイティブ業務(17.2%)は、最も著作権リスクが高い領域です。外部公開するコンテンツでは、既存著作物との類似性チェックが必須です。

中リスク領域:システム開発

システム開発(37.4%)では、AIが生成したコードがオープンソースライセンスに抵触していないかの確認が必要です。

リスク対応のためのガイドライン整備

ガイドラインに含めるべき項目

調査では19.4%が「ガイドライン整備の遅れ」を課題として認識しています。法的リスクに対応するため、以下の項目を含むガイドラインを整備することが推奨されます。

1. 利用目的の明確化

利用目的 | 可否 | 条件 |

|---|---|---|

社内業務効率化 | ○ | 機密情報の取り扱いに注意 |

社内文書作成 | ○ | 人間によるレビュー必須 |

社外公開コンテンツ | △ | 類似性チェック必須 |

商品・サービス開発 | △ | 法務部門との事前協議 |

顧客向け提案資料 | △ | 出典明示、検証必須 |

2. 出力内容の取り扱いルール

- AI生成であることの明示要否

- 類似性チェックの実施方法

- 人間による加筆・修正の推奨

- 出典・引用の表記ルール

3. 禁止事項の明示

- 他者の著作物の丸写し入力

- 商標・ブランド名を含む画像生成

- 実在人物の肖像を含む画像生成

- 誹謗中傷、差別的表現の生成

4. 承認フローの設定

コンテンツの種類 | 承認プロセス |

|---|---|

社内文書 | 上長承認 |

社外公開(軽微) | 担当部門承認 |

社外公開(重要) | 法務部門確認 |

商用利用 | 経営層承認 |

実務上のチェックリスト

コンテンツ公開前チェックリスト

外部に公開するAI生成コンテンツについて、以下の項目を確認します。

チェック項目 | 確認内容 |

|---|---|

□ 類似性チェック | 既存コンテンツとの類似性を確認 |

□ 商標チェック | 商標・ブランド名の不正使用がないか |

□ 肖像権チェック | 実在人物の肖像が含まれていないか |

□ 出典明示 | 引用がある場合は出典を明記 |

□ 人間レビュー | 担当者による内容確認を実施 |

□ 承認取得 | 必要な承認を取得 |

まとめ

本調査により、以下の点が明らかになりました。

- 28.3%が著作権・コンプライアンスを課題として認識し、第3位の重要課題

- AI生成コンテンツの著作権帰属は不明確な部分が多く、人間の関与が重要

- コンテンツ作成・クリエイティブ領域は特にリスクが高い

- ガイドライン整備とエンタープライズサービス活用がリスク軽減の鍵

法的リスクを過度に恐れてAI活用を停滞させるのではなく、適切なリスク管理のもとで積極的に活用を進めることが重要です。本レポートの内容を参考に、安全な生成AI活用を実現してください。

生成AIの法的リスク対応でお悩みの方へ

「AI活用のガイドラインを整備したい」「セキュリティとコンプライアンスを担保しながらAIを導入したい」——そのようなお悩みをお持ちではありませんか?

Ragate株式会社では、AI TRiSMフレームワークに基づいたリスク評価とガバナンス策定を含むAX(AI Transformation)支援を提供しています。セキュリティ、コンプライアンス、品質管理を包括的にカバーした生成AI活用体制を構築します。

▶ AX実現伴走支援・Dify開発支援サービスの詳細はこちら

また、エンタープライズ向けの安全なAI基盤構築をご希望の方には、AWS FTR認定を取得した専門チームによるAmazon Bedrock導入支援もご用意しています。