Gemma 4とは — Googleが放つ次世代オープンソースLLMの全貌

2026年4月、Googleは最新のオープンソース大規模言語モデル「Gemma 4」を発表しました。Gemma シリーズはGoogleが2024年から展開してきたオープンモデルファミリーで、今回の第4世代は「バイト当たり最も能力の高いオープンモデル」をコンセプトに掲げています。

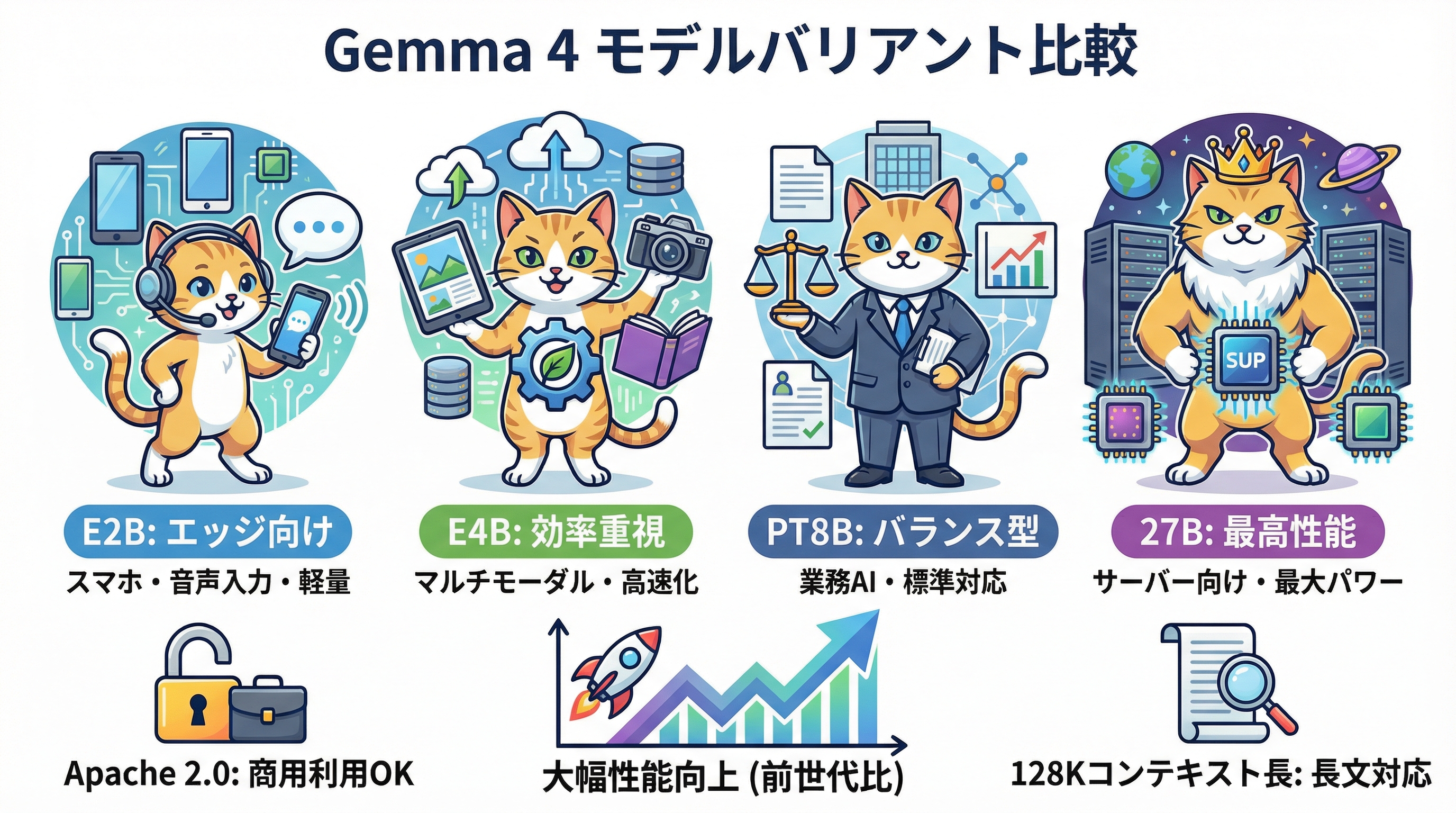

最も注目すべき変更点のひとつが、ライセンスの刷新です。Gemma 3まではGoogle独自の利用規約が設けられていましたが、Gemma 4ではApache 2.0ライセンスに変更されました。これにより、商用プロダクトへの組み込みや社内システムへの導入が格段に行いやすくなっています。クローズドなビジネス環境でLLMを活用したいエンジニアにとって、このライセンス変更は実務上の大きなメリットです。

Gemma 4は以下の4種のモデルバリアントで構成されています。

モデル名 | パラメータ規模 | コンテキスト長 | 主な特徴 |

|---|---|---|---|

E2B(Edge 2B) | 約20億 | 128K | エッジ向け・スマートフォン動作・音声入力対応 |

E4B(Edge 4B) | 約40億 | 128K | エッジ向け・スマートフォン動作・音声入力対応 |

26B A4B | 約260億(MoE・推論時アクティブ約38億) | 256K | 低レイテンシ重視・Mixture of Experts構造 |

31B Dense | 約310億 | 256K | 高精度・ファインチューニング向け・Dense構造 |

モデルはすべてGoogle AI Studio、Hugging Face、Ollama、Docker、NVIDIA NIM/NeMoなど主要プラットフォームから利用できます。特にHugging Faceからは重みを直接ダウンロードして自前のインフラで運用できるため、データをクラウドに送りたくない社内利用のユースケースにも対応しています。

Gemma 3からどう変わったか — 主要アップデートを整理する

Gemma 4はGemma 3から複数の重要な改良が加えられています。アーキテクチャ・ライセンス・対応モダリティの全面的な進化です。

コンテキスト長の大幅拡張

Gemma 3の最大コンテキスト長は128Kトークンでしたが、Gemma 4の大型モデル(26B・31B)では256Kトークンまで拡張されました。長文書のサマリー、複数ファイルのコードレビュー、長期の会話履歴保持など実務での活用幅が広がっています。

ライセンスの商用フレンドリー化

前述のとおり、Google独自ライセンスからApache 2.0への変更は実務インパクトが大きい変更です。社内サービスへの組み込みや商用SaaSへの統合をスムーズに進められます。

音声入力のネイティブサポート

エッジモデル(E2B・E4B)では、テキスト・画像に加えて音声入力がネイティブでサポートされるようになりました。音声認識・理解タスクをモデル単体で処理できるため、音声インターフェイスを組み込んだアプリケーションの開発が簡便になります。

アーキテクチャの改良

内部的には以下の改良が施されています。

- Dual RoPE設定: スライディングレイヤーには標準RoPE、グローバルレイヤーには比例RoPEを使い分けることで、長コンテキスト処理を効率化しています。

- Shared KV Cache: 末尾のNレイヤーが前レイヤーのキーバリュー状態を再利用することで、冗長なKV計算を削減しています。

- 画像エンコーダの改善: 可変アスペクト比と設定可能な画像トークン数に対応し、解像度に柔軟に対処できるようになりました。

reasoning(思考)モードの追加

Gemma 4では全モデルに思考モード(thinking mode)が追加されています。モデルが回答の前に内部的な推論ステップを行うことで、複雑な数学・コーディング・科学的問題においてより精度の高い出力が得られます。

技術仕様を深掘りする — マルチモーダル・推論・関数呼び出し

Gemma 4の技術的特徴を詳しく見ていきましょう。特に業務でLLMを活用するエンジニアが気になる「何ができるか」の観点で整理します。

マルチモーダル対応

Gemma 4の全モデルがテキスト・画像・動画をネイティブで処理できます。画像は可変解像度・アスペクト比に対応しており、OCR(文字認識)やグラフ・チャートの読み取りに優れているとされています。E2B・E4Bでは音声入力も追加されているため、マルチモーダルの幅がさらに広がっています。

ネイティブ関数呼び出しとJSON出力

Gemma 4は関数呼び出し(function calling)と構造化JSON出力をネイティブでサポートしています。これにより、外部APIやデータベースと連携するエージェント型のアプリケーションを構築する際に、出力形式の変換処理を減らすことができます。また、システムロールのネイティブサポートが追加され、より制御しやすいチャット構成が可能になっています。

Mixture of Experts(MoE)構造

26Bモデルはパラメータ総数は約260億ですが、推論時には約38億のアクティブパラメータのみが動作するMoE(Mixture of Experts)構造を採用しています。これにより、品質を維持しながら推論コストを抑えられるという特性があります。レイテンシを重視するリアルタイムAPI用途に向いています。

ベンチマーク(公式報告値)

Googleが公式に報告しているベンチマーク値として、数学推論タスク(AIME)で約89%、コーディングベンチマーク(LiveCodeBench)で約80%、科学推論(GPQA)で約84%という数値が示されています。Arena AIのリーダーボードでは31Bモデルがオープンモデルトップ3、26BモデルがトップB相当と報告されています。ただし、ベンチマーク値は測定条件によって変動するため、あくまで参考値として理解した上で実際のユースケースで評価することを推奨します。

AWSで動かすGemma 4 — EC2・SageMaker・Inferentiaの選び方

Ragateがクライアントに提供するAWS活用支援の文脈で、Gemma 4をAWSクラウド上でどのように運用するかを整理します。主な選択肢は3つです。

EC2 GPU インスタンス(フル制御・低コスト)

量子化モデルであればg6.2xlarge(NVIDIA L4 24GB)、フル精度の31Bモデルにはp5.xlarge(H100)が適しています。環境をフルコントロールできる反面、スケーリング・監視は自前実装が必要です。研究・検証環境や予測可能なワークロードに向いています。

Amazon SageMaker マネージドエンドポイント(運用負荷軽減)

オートスケーリング・A/Bテスト・モニタリングが管理された環境で利用できます。EC2比でコストは15〜40%増になりますが、MLOps的な運用工数を大幅に削減できます。本番API環境やトラフィックが変動する用途に推奨です。

AWS Inferentia2(コスト最適化)

Neuron SDK + vLLMの構成でinf2.xlargeを使うと、GPUインスタンス比で約40%のコスト削減が報告されています。量子化が前提になりますが、大量リクエストをさばくAPIでコスト最適化を優先する場合に有効です。

RagateはAWSパートナーとして、ワークロードに応じた構成設計を提供しています。プライベートVPC内でオープンソースLLMを閉じて運用したいケースでは、EC2またはInferentia2を使ったプライベートエンドポイント構成が有効です。

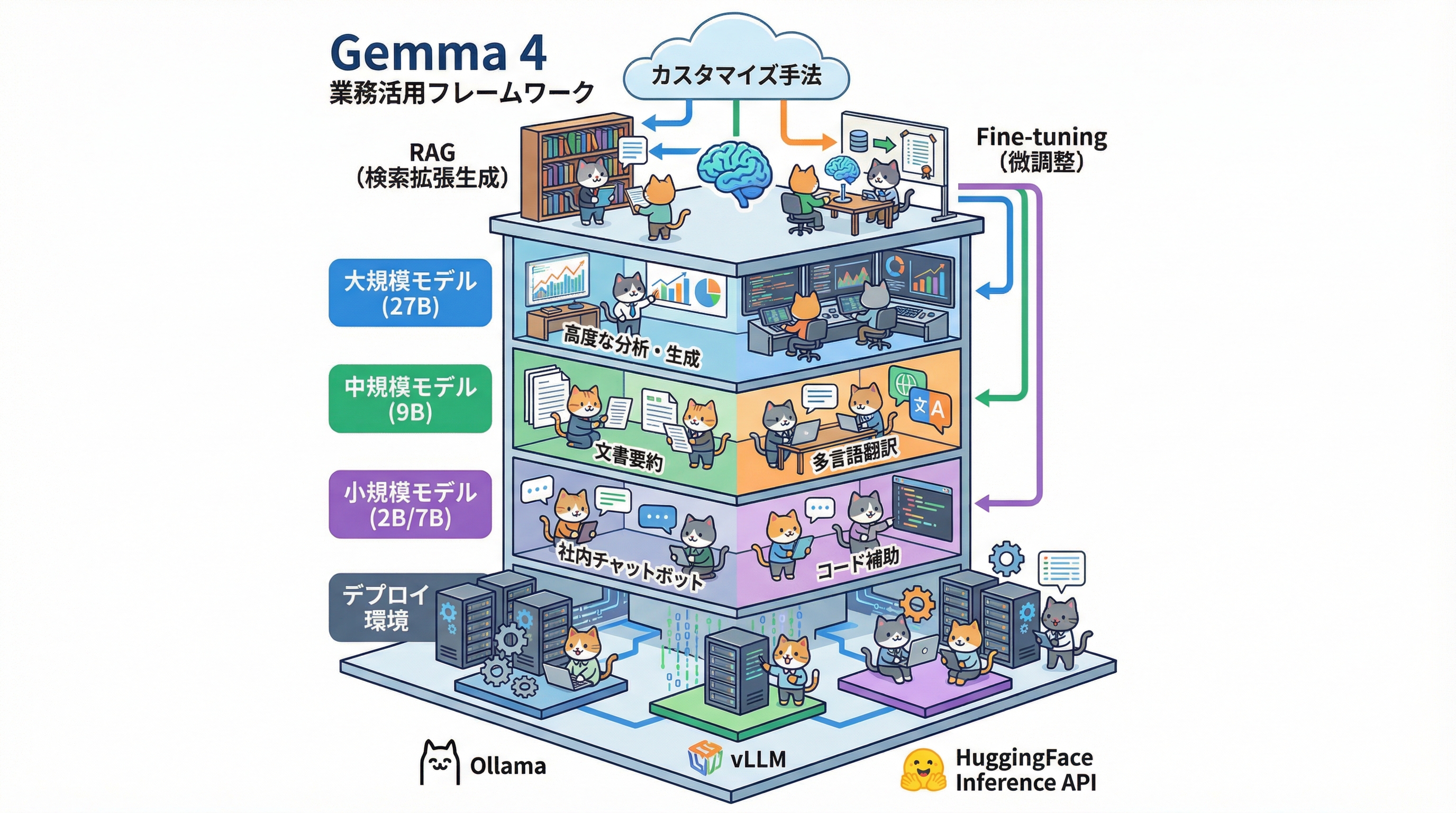

社内エンジニアが使うべきユースケース5選

Gemma 4の特性を踏まえると、特に以下のユースケースで実務上のメリットが得られます。

1. 社内RAGシステム(Retrieval-Augmented Generation)

256Kという長いコンテキスト長を活かして、社内ドキュメント・技術仕様書・過去の議事録を取り込んだRAGシステムの構築に向いています。Apache 2.0ライセンスでオンプレミスやプライベートVPCに閉じて運用できるため、機密情報を外部APIに送らないセキュアな構成が実現できます。

2. 会議・音声コンテンツの自動処理

E2B/E4BのネイティブAudio対応を活用し、会議録音の文字起こし・要約・アクションアイテム抽出を一貫して処理できます。Ragateが推進する「AI議事録自動化」の文脈では、Gemma 4のエッジモデルをモバイル端末に組み込む形でオフライン処理する構成も検討できます。

3. コーディング支援・コードレビュー

thinking modeと関数呼び出しを組み合わせることで、コードの問題検出・修正提案・テストコード生成といった開発支援タスクに活用できます。ベンチマークではLiveCodeBenchで約80%を記録しており、コーディング領域での精度が向上しています。

4. マルチモーダルな帳票・チャート分析

画像・PDFスキャン・グラフのOCRと解析が1つのモデルで完結します。請求書・契約書の自動読み取りや、Excelグラフを画像として受け取って数値を抽出するといった業務フローへの統合が可能です。

5. エージェント型ワークフローの構築

ネイティブのfunction callingと構造化JSON出力を活用すると、外部APIやデータベースと連携した自律型エージェントを構築できます。Slackと連携した質問応答ボット、社内申請の自動処理エージェント、AWSリソースの状態確認エージェントなど、実務ベースの応用が広がります。

導入前に知っておきたい注意点と現時点の制限

Gemma 4を実際に業務投入する前に、現時点で把握しておくべき制限と注意点を整理します。

VRAMとコンテキスト長のトレードオフ

Gemma 4はKVキャッシュのVRAM消費が多いとされており、理論上は256Kのコンテキスト長をサポートしていますが、単一GPUでの実用運用では8K〜32K程度が現実的な上限になりやすいとの報告があります。長コンテキストを活かしたい場合はマルチGPU構成やInferentia2の活用を検討してください。

推論フレームワークの対応状況

Gemma 4の異種ヘッド次元に対するFlashAttentionの対応が開発中であり、リリース直後の段階では推論速度が最適化されていないケースがあります。vLLMやHugging Face Transformersは積極的に対応を進めているため、利用するフレームワークのバージョンを最新に保つことが重要です。

ファインチューニングの難易度

Gemma 3と比較してファインチューニングの難易度が上がっているとの報告があります。LoRA・QLoRAを使ったPEFTチューニングのツール対応もリリース直後はタイムラグが生じる場合があります。プロダクション向けにファインチューニングを計画している場合は、ツールの成熟度を確認した上で着手することを推奨します。

セキュリティ上の考慮点

Gemma 4の関数呼び出し機能を使う際、生成された関数コールに対して人間の承認を記録・追跡する仕組みがモデル側には組み込まれていません。エージェントが外部システムを操作するワークフローでは、アプリケーション層でのアクセス制御・ログ記録・承認フローの実装が必須です。また、基本的なシステムプロンプトでのプロンプトインジェクションに対する脆弱性が初期段階で報告されているため、入力値のバリデーションとサンドボックス設計を徹底してください。

モデルの成熟度

リリース直後はLM Studioなど一部のローカル実行環境でクラッシュが報告されています。本番投入前に、利用するランタイムとGemma 4の組み合わせで十分な検証を行うことが重要です。コミュニティのフィードバックを確認しながら、安定版のリリースを待って導入するという判断も合理的です。

RagateはAWS活用とAI導入の両面からクライアントを支援しており、Gemma 4のような最新モデルを安全・効率的に業務システムへ組み込む設計・実装支援を提供しています。オープンソースLLMを活用した業務自動化・AX推進についてはお気軽にご相談ください。