2026年4月、OpenAIは立て続けに重大発表を行いました。4月21日に思考機能付き画像生成モデル「gpt-image-2」、4月23日に次世代言語モデル「GPT-5.5」、4月28日にAmazon Bedrock連携の限定プレビュー、そして4月30日にエンタープライズ向け「Workspace Agents」のリリースと、まさにAIの春といえる怒涛の一ヶ月でした。

これらの発表はそれぞれ独立したアップデートに見えますが、エンジニアの開発ワークフローという観点で見ると、コーディング支援・UIプロトタイピング・業務自動化・クラウド統合という4つの軸で大きな変化をもたらすものです。本記事では、各発表の技術仕様と実際の活用シナリオをクラウドネイティブエンジニア向けに詳しく解説します。

GPT-5.5が切り開くコーディング支援の新時代

2026年4月23日にリリースされたGPT-5.5は、OpenAIがコーディング・コンピューター操作・知識作業・科学研究の4分野に特化して開発した次世代モデルです。

ベンチマーク性能

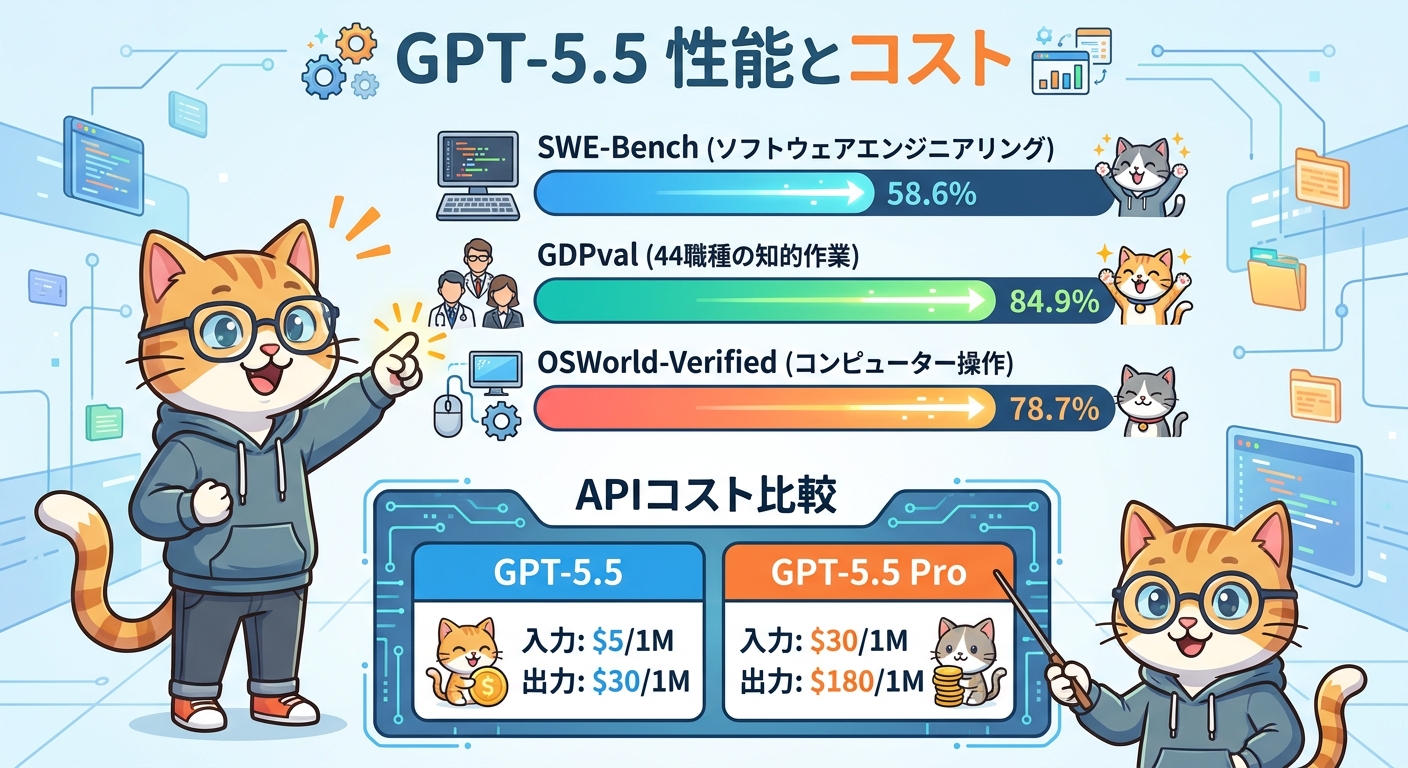

GPT-5.5の実力は、複数の業界標準ベンチマークで確認できます。

ベンチマーク | スコア | 評価内容 |

|---|---|---|

SWE-Bench | 58.6% | 実際のGitHubイシューを自律解決するソフトウェアエンジニアリングタスク |

GDPval | 84.9% | 弁護士・会計士・エンジニアなど44職種の知的作業 |

OSWorld-Verified | 78.7% | 実際のコンピューター操作タスク(ブラウザ・アプリ操作等) |

SWE-Benchの58.6%という数値は、実際のリポジトリ上のバグ修正や機能追加といったタスクを自律的に解決できる割合を示しています。OpenAI社内では、Codexと組み合わせることでエンジニアの85%以上が毎週GPT-5.5を活用しているとのことです。

APIコストと1Mトークンコンテキスト

エンジニアがAPI経由で利用する際に重要なのがコストです。GPT-5.5のAPIコストは以下の通りです。

モデル | 入力(1Mトークン) | 出力(1Mトークン) |

|---|---|---|

GPT-5.5 | $5 | $30 |

GPT-5.5 Pro | $30 | $180 |

さらに注目すべきは1Mトークンのコンテキストウィンドウです。大規模なコードベース全体をプロンプトに含めてレビューを依頼したり、複数ファイルにまたがるリファクタリングを一括で依頼したりといった、これまで困難だった用途が現実的になります。実際の活用例として、数万行規模のモノリスアプリケーションをマイクロサービスへ分割する際の依存関係分析や、大規模なテストスイートの自動生成などが挙げられます。

gpt-image-2の思考機能が変えるUIプロトタイピング

4月21日にリリースされた「gpt-image-2」は、OpenAI初の思考機能付き画像生成モデルです。O系推論アーキテクチャを統合することで、従来の画像生成モデルとは一線を画す能力を実現しています。

思考機能とは何か

従来の画像生成モデルはプロンプトを直接画像に変換していましたが、gpt-image-2は生成前に「思考ステップ」を踏みます。たとえば「ECサイトのカート画面のモックアップを生成して」というプロンプトに対して、一般的なUIパターン・アクセシビリティ要件・デバイスの種類・ユーザーの操作フローを考慮した上で画像を生成します。

これにより、抽象的・曖昧なプロンプトからでも意図に沿った画像が生成されるようになりました。

主要スペック

項目 | 仕様 |

|---|---|

最大解像度 | 2K(2048×2048等) |

1プロンプト最大生成数 | 8枚(バリエーション一括生成) |

多言語テキスト精度 | 日本語・韓国語・中国語・ヒンディー語等 約99% |

Image Arenaランキング | 1位(2位との差は1,512点) |

エンジニアにとっての実用価値

日本語テキストの画像内描写精度が約99%に達したことは、日本語UIの開発に携わるエンジニアには特に大きな意味を持ちます。これまでの画像生成モデルでは、日本語テキストが文字化けしたり不自然な字形になることが頻繁にありました。gpt-image-2ではこの問題がほぼ解消されており、「このボタンには「購入する」と表示してください」という指定が正確に反映されます。

またCodexへの統合により、エンジニアはコーディング作業の流れの中でUIモックアップを直接生成できるようになりました。仕様書からコンポーネントのコードとビジュアルを同時に生成するといったワークフローが実現しています。

OpenAI Workspace Agentsで実現するエンタープライズ自動化

4月30日にChatGPT Enterprise/Edu向けにリリースされた「Workspace Agents」は、GPTsをCodexで強化したエンタープライズ向けエージェントです。

Workspace Agentsの概要

Workspace AgentsはSlackやSharePointなどの企業内システムと直接連携し、マルチステッププロセスを自動実行するエージェントです。これまでのGPTsが単発の質問応答に留まることが多かったのに対し、Workspace AgentsはCodexの力を借りて複数のステップを持つ複雑な業務プロセスを自律的に遂行できます。

具体的なユースケース

エンジニアの業務において特に活用が期待されるシナリオは以下の通りです。

ユースケース | 連携システム | 自動化内容 |

|---|---|---|

週次開発レポート生成 | Slack + GitHub | Slackのトリガーを受け、GitHubのコミット・PR情報を集約してサマリーを作成 |

ドキュメント自動要約 | SharePoint | 新規ドキュメントの追加を検知し、要約をSlackチャンネルへ通知 |

コードレビュー支援 | Codex統合 | PRのオープンをトリガーに自動レビューコメントを作成 |

インシデント対応支援 | Slack + ナレッジベース | アラートを受けて関連ドキュメントを検索し、対応手順を提示 |

ChatGPT Enterprise/Eduのユーザーであれば、既存のGPTs設定にWorkspace Agents機能を追加するだけで利用を開始できます。セキュリティ面では、既存のChatGPT Enterpriseのデータプライバシーポリシーがそのまま適用されるため、企業情報の取り扱いについて追加の設定は不要です。

Amazon BedrockでOpenAIモデルを使う方法と活用シナリオ

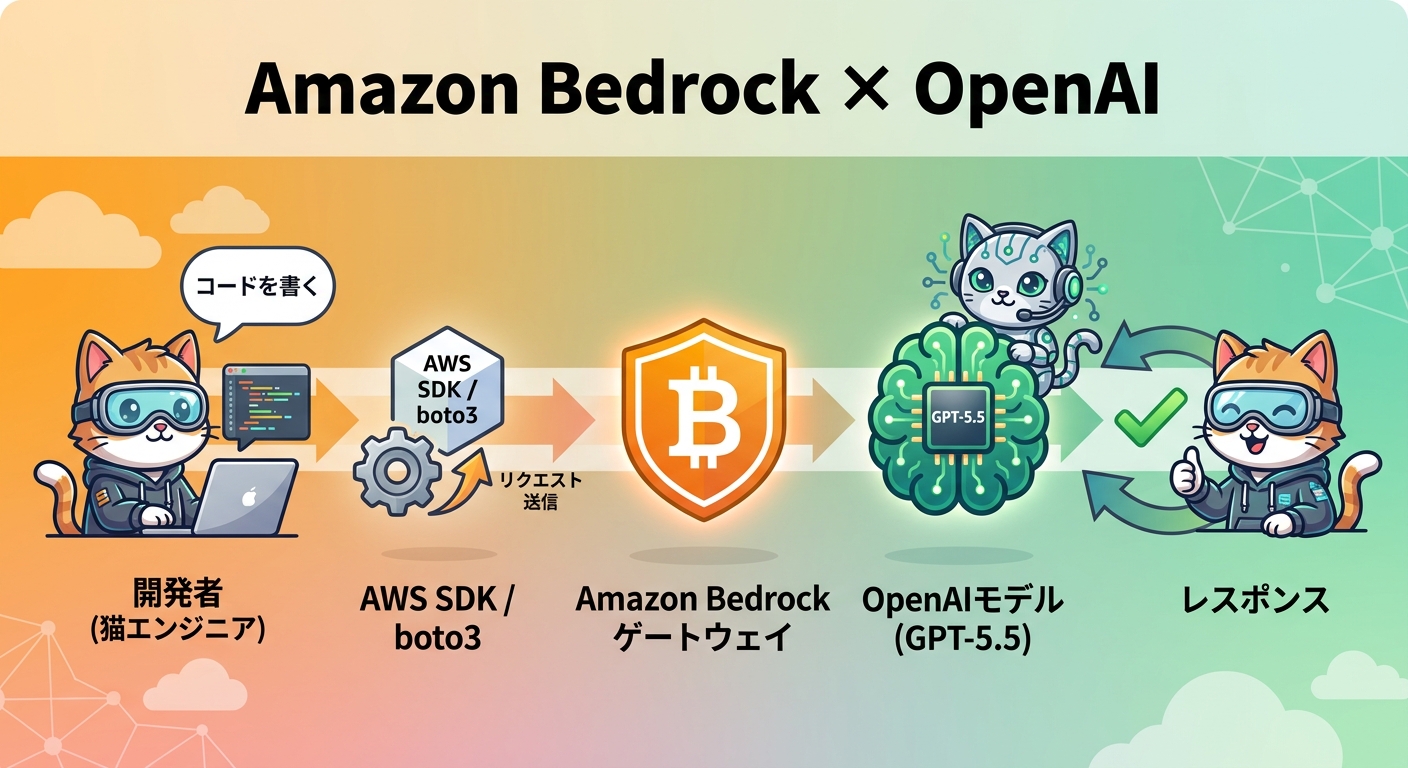

4月28日に限定プレビューが開始された「OpenAI on AWS」は、Amazon Bedrock経由でGPT-5.5などのOpenAIモデルをAWS環境から利用できるサービスです。AWSを基盤とするシステムにOpenAIモデルを組み込みたいエンジニアにとって、最も注目すべき発表といえるでしょう。

提供される機能

サービス | 内容 |

|---|---|

OpenAI on Amazon Bedrock | GPT-5.5等のOpenAIモデルをBedrock API経由で呼び出し可能 |

Codex on AWS | コーディングエージェントをAWSインフラ上で実行 |

Amazon Bedrock Managed Agents (powered by OpenAI) | OpenAIモデルを用いたフルマネージドエージェント環境 |

AWSユーザーにとってのメリット

OpenAI APIを直接利用する場合と比較したとき、Amazon Bedrock経由での利用には以下のような実務上のメリットがあります。

まずセキュリティとコンプライアンスの面では、AWS IAMによるアクセス制御やVPCエンドポイントを通じたプライベートな通信が可能です。既存のAWSセキュリティポリシーやAuditログの仕組みをそのままOpenAIモデルの呼び出しに適用できます。

次にコスト管理の面では、OpenAI on AWSの利用分を既存のAWS spending commitment(Enterprise Discount ProgramやEnterprise Agreement)に充当できます。AWSとOpenAIで別々の請求が発生していた場合に、請求を一元管理できるようになります。

さらにモニタリングとオブザーバビリティの面では、Amazon CloudWatchによるAPI呼び出しのログ記録・メトリクス収集・アラート設定が利用できます。既存のAWS監視基盤にOpenAIの呼び出しを組み込めるため、運用コストを抑えることができます。

利用イメージ

Bedrock APIを通じた呼び出しは、既存のAWS SDK(boto3等)をそのまま利用できます。OpenAI APIとほぼ同様のリクエスト形式で利用できるため、既存コードの移行コストも最小限に抑えられる設計になっています。なお2026年5月時点ではまだ限定プレビューであり、一般提供の時期はOpenAIとAWSの公式発表を待つ必要があります。

Spring 2026発表が示すAI開発の方向性

今回のOpenAIのSpring 2026発表を俯瞰すると、いくつかの明確な方向性が見えてきます。

エージェント化の加速

GPT-5.5のCodexとの統合、Workspace AgentsのSlack/SharePoint連携、Amazon Bedrock Managed Agentsと、今回の発表すべてに「エージェント」という共通テーマがあります。モデルを呼び出して返答を得るという従来の使い方から、モデルが自律的にツールを使い・複数ステップを実行し・システムを横断して成果物を生成するという使い方へと、AIの活用が移行しています。

マルチモーダルとコーディングの融合

gpt-image-2のCodex統合は、テキスト生成と画像生成が同じコーディングワークフロー内に統合されることを意味します。UIの仕様を書けば、コードとビジュアルが同時に生成される未来はすでに始まっています。

エンジニアが今すぐ取り組むべきこと

これらの発表を受けて、クラウドネイティブエンジニアが具体的に検討すべき行動は以下の通りです。GPT-5.5のAPIを試してみるには、まずOpenAI Platformでアカウントを設定し、小規模な実験から始めることをおすすめします。Amazon Bedrock経由での利用に関心がある場合は、限定プレビューのウェイトリストへの登録を検討してください。Workspace AgentsはChatGPT Enterpriseのサブスクリプションを持つ組織であればすでに利用可能な機能があります。まずは日常的なSlack通知やドキュメント要約など、小さな自動化から試してみるとよいでしょう。

AI技術の進化は速く、今回紹介した機能も数ヶ月後にはさらに進化していると考えられます。継続的に公式ドキュメントやOpenAIのブログをフォローしながら、実務への適用を探っていくことが重要です。