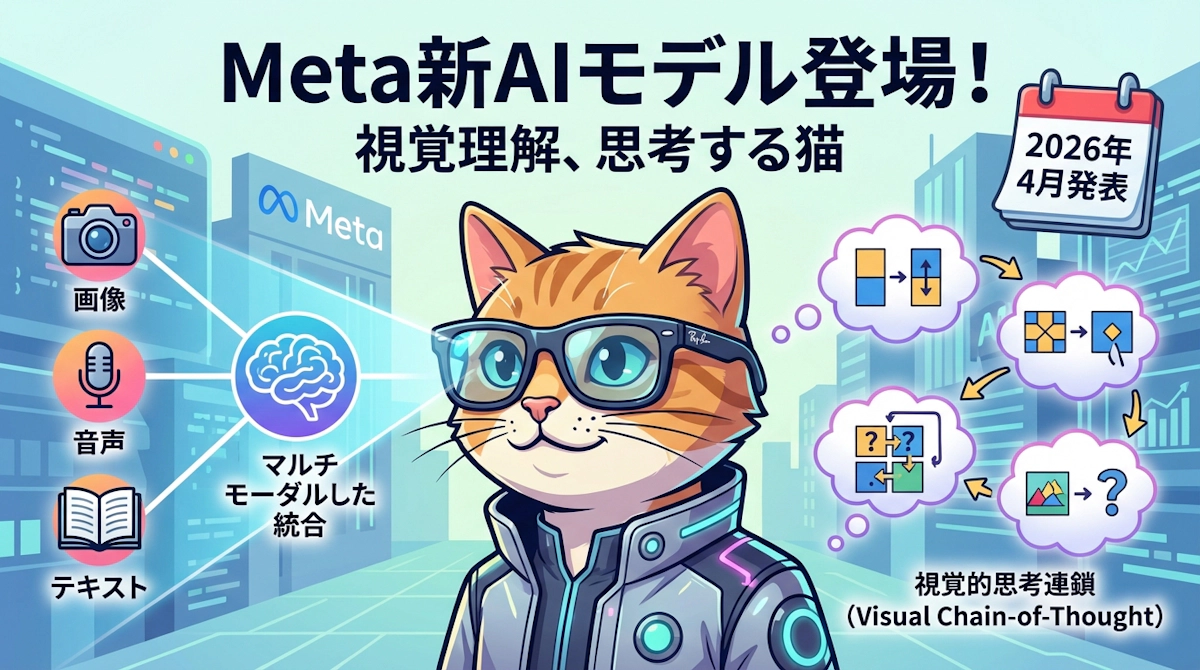

2026年4月8日、Meta Superintelligence Labs(MSL)が新世代AIモデル「Muse Spark」を発表しました。視覚理解を核に据えたネイティブマルチモーダル設計と、Ray-Ban Metaメガネとの統合計画は、AI・機械学習エンジニアにとって見逃せないニュースです。これまでMetaといえばオープンウェイトのLlamaシリーズが代名詞でしたが、Muse SparkはMetaはじめてのクローズドモデルという点でも大きな転換点となっています。本記事では、Muse Sparkの技術的特徴から、ウェアラブルデバイスへの展開可能性、他社視覚AIとの比較まで体系的に整理します。

Meta Superintelligence Labsが生み出した「Muse Spark」とは

Muse Sparkを理解するには、その生みの親であるMeta Superintelligence Labs(MSL)の背景を押さえる必要があります。MSLはCEOのマーク・ザッカーバーグ氏が、既存のLlamaシリーズの進捗に対して改めてAI競争での主導権奪取を宣言し、元Scale AI CEOのアレクサンダー・ワン氏を招いて設立した組織です。Muse SparkはそのMSLが送り出す第一弾の成果物となりました。

Metaは公式ブログで「Scaling Towards Personal Superintelligence(個人向け超知性に向けたスケーリング)」と題し、Muse Sparkを長期ビジョンの「最初のステップ」と位置づけました。単なる新モデルの発表ではなく、Metaが目指す方向性を高らかに示した宣言ともいえます。

もうひとつ大きな変化が、Metaとしてはじめてオープンウェイト(公開重み)を採用しないクローズドモデルとして提供された点です。これまでLlamaシリーズでオープンソース路線を強みとしてきたMetaが、競合他社と同様のクローズドモデル戦略に踏み切った背景には、商業的な競争力の確保と、強力なAI能力のコントロールを両立させたいという判断があるとみられます。現在はMeta AIアプリおよびWeb経由での利用が可能で、APIの一般公開は「近日予定」とされています。

視覚理解AIとしてのMuse Sparkの技術的特徴

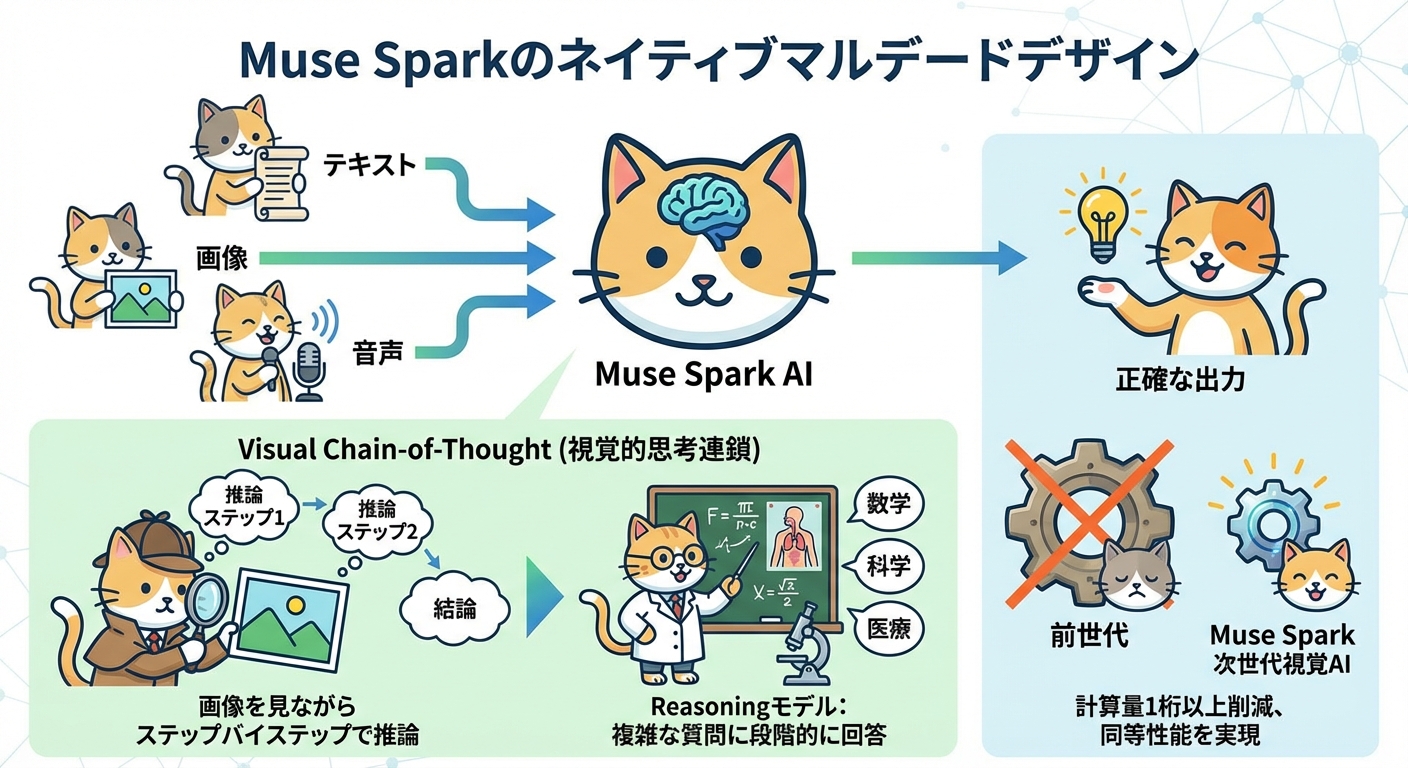

Muse Sparkの最大の特徴は「ネイティブマルチモーダル設計」です。テキスト・音声・画像を入力として受け付け、視覚・言語・推論を統合的に処理できるアーキテクチャを採用しています。現時点での出力はテキストのみですが、視覚情報を受け取って推論するという点で、従来のLLMとは根本的に異なるアプローチを取っています。

特に注目すべきは「Visual Chain-of-Thought(視覚的思考連鎖)」機能です。これは画像を単に説明するだけでなく、リアルタイムで画像にアノテーションを加えながら段階的に推論していく機能です。例えば家電の故障診断では、エラー表示の画像を見ながらステップバイステップで原因を特定したり、スーパーの棚に並んだ商品の写真からタンパク質含量を比較ランキングしたりといったユースケースが想定されています。STEMの教育分野でも、数式や図を見ながら解き方を解説するといった活用が期待されます。

推論アーキテクチャとしては、従来のMetaモデルが採用していた即答型(instant answer)とは異なり、ステップバイステップで思考するReasoningモデルを採用しています。これにより数学・科学・医療など複雑な質問に対しても、より信頼性の高い回答が得られます。医療分野では1,000人以上の医師と共同でトレーニングデータをキュレーションしており、健康相談や症状解析といった高度な専門領域への対応も特徴のひとつです。

性能効率の面でも大きな進化が見られます。公式発表によれば、前世代のLlama 4 Maverickと比較して「1桁以上少ない計算量(over an order of magnitude less compute)」で同等の能力を達成したとされています。事前学習・強化学習・テスト時推論(test-time compute)の3軸で改善を図った結果です。さらに複数のサブエージェントを並行実行するマルチエージェント機能も備えており、旅行計画や複合的なタスクを効率的に処理できます。

Ray-Ban MetaメガネとのAI統合が変える日常体験

Muse Sparkで特にエンジニアが注目すべきなのが、Ray-Ban Metaスマートグラスとの統合計画です。Metaは発表と同時に、WhatsApp・Instagram・Facebook・Messenger、そしてAIメガネへの段階的なロールアウトを「数週間以内」(2026年4月8日時点)に行うと明言しました。

Ray-Ban Metaは現在第4世代が展開中であり、一部メディアは「世界で最も売れているスマートグラス」と評しています(販売台数の公式データは未公表)。Muse SparkのMeta AIがメガネに統合されることで、ユーザーが実際に見ている環境をAIがリアルタイムで認識・分析できるようになります。

具体的なシナリオとして、スーパーの棚の前でメガネ越しに商品を見るだけで、AIが各商品の栄養成分を比較して最適な選択肢を提案するといった使い方が挙げられます。旅行先の看板やメニューの翻訳、道に迷ったときのナビゲーション、あるいは仕事の場面でのリアルタイムな情報補完なども実現可能です。スマートフォンを取り出す手間なく、視界の中でAIが自然に情報を提供する体験は、モバイルアプリとは根本的に異なるインタラクションモデルを作り出します。

エンジニアの視点からは、この統合は「エッジAI」と「クラウドAI」の融合という興味深い技術課題を示しています。メガネという極めてリソースが限られたデバイスで視覚情報を収集し、クラウド側のMuse Sparkで高度な推論を行い、低遅延で結果を返すアーキテクチャの実現がポイントです。

次世代ウェアラブルデバイスへの展開可能性

Muse Sparkのウェアラブルへの応用はスマートグラスにとどまりません。MetaはMeta Questシリーズをはじめとするスマートグラス市場において、AppleやGoogleより先行したポジションを持っています。視覚理解AIとVR/ARの融合は、次世代コンピューティングの主戦場になるとも言われています。

常時AIアシスタントとしての可能性も大きいです。現在のスマートフォン上のAIアシスタントは、ユーザーが意識的にアプリを起動して操作する必要がありますが、ウェアラブル上では視界に映るものをAIが継続的に観察し、ユーザーが求める前に適切な情報や提案を提示できる「プロアクティブなAI」が実現します。これはスマートフォン時代のAI体験とは質的に異なるパラダイムシフトです。

Apple Vision Proのような空間コンピューティングデバイスへの具体的な統合ロードマップは現時点では公式発表されていませんが、AR/VRヘッドセットとMuse Sparkの親和性は技術的に高く、今後の展開が注目されます。Meta Quest等の次世代デバイスへの展開も今後の計画とみられます。

一方、常時視覚認識AIが搭載されたウェアラブルにはプライバシー上の懸念もつきまといます。誰が撮影されているのか、データはどこに送られるのか、映像はどこまで記録されるのかといった問題は、技術的な実現可能性とは別に、社会的な合意形成が必要です。MetaがこうしたプライバシーデザインをMuse Sparkの展開においてどのように扱うかは、業界全体への影響を持つ重要な論点となるでしょう。

Google Lens・Apple Visual Intelligenceとの比較

視覚AIの領域では、すでにGoogle LensやAppleのVisual Intelligenceといった強力な競合が存在します。Muse Sparkはこれらとどのように異なるのでしょうか。

Google Lensは、テキスト認識・商品検索・植物や動物の識別など、幅広いカテゴリをカバーする汎用視覚検索ツールとして高い完成度を誇ります。Android・iOSを問わずデバイス横断で利用でき、Google検索・マップ・翻訳との深い連携も強みです。一方でステップバイステップの推論や健康・STEM分野への特化、マルチエージェント処理といった機能はMuse Sparkが上回るとされています。

Apple Visual IntelligenceはiPhone 16シリーズのCamera Controlボタンに紐づいた視覚AI機能で、Appleエコシステム内での完結性が最大の強みです。ただしiPhone 16以降の機種限定という制約があり、他社デバイスや汎用APIとしての展開には向きません。エコシステム内では非常に洗練された体験を提供する一方、オープンな活用可能性という点ではMuse Sparkに軍配が上がります。

独立した評価機関であるArtificial Analysis Intelligence Indexによれば、Muse SparkはスコアAA-52を記録し、世界4位(Gemini 3.1 Pro・GPT-5.4・Claude Opus 4.6に次ぐ)とされています。視覚能力を測るMMTU-Proベンチマークでは80.5%を記録し、Gemini 3.1 Pro(82.4%)に次ぐ世界2位という高い成績を示しています。ただし、実世界の複雑なエージェントタスクを評価するGDPval-AAではスコア1427にとどまり、競合モデルに後れを取っている点は課題として認識しておく必要があります。

総じてMuse Sparkは視覚理解の精度という点では最前線に位置しつつ、複合的なエージェント動作においては競合との差を詰めている段階といえます。

エンジニアとして注目すべきMuse Sparkの今後

エンジニアにとってMuse Sparkで最も気になるのは、APIの公開時期とその設計です。現時点では「近日予定」とされているのみですが、APIが公開されれば視覚理解能力を持つAIをウェアラブルアプリや業務システムに組み込む選択肢が一気に広がります。

Metaがクローズドモデルを選択したことは、開発者エコシステムへのアプローチにも影響を与えます。これまでLlamaをベースにローカル実行や独自ファインチューニングを行っていた開発者は、Muse SparkについてはAPIを通じたクラウドアクセスという形態に慣れる必要があるかもしれません。一方で、Metaがクローズドモデルとして管理することにより、視覚認識の精度やモデルのバージョン安定性が保証されやすくなるという利点もあります。

ウェアラブル向けAIアプリ開発という観点では、スマートグラスとのAPI連携が実現すれば、これまで実現できなかったハンズフリーの視覚AIアプリケーション開発が可能になります。例えば、製造現場での設備点検支援、医療現場での症状記録・解析、教育現場でのリアルタイム解説アシスタントといった業務特化のユースケースが現実的な開発テーマとして浮上します。

視覚AIの進化は2026年以降も急速に続くことが見込まれます。Muse Sparkはその最前線のひとつに位置しており、APIの公開動向・ベンチマーク評価の推移・ウェアラブルとの統合事例を追うことは、AI・機械学習エンジニアとして技術選定や設計方針を考える上で重要なインプットになるでしょう。