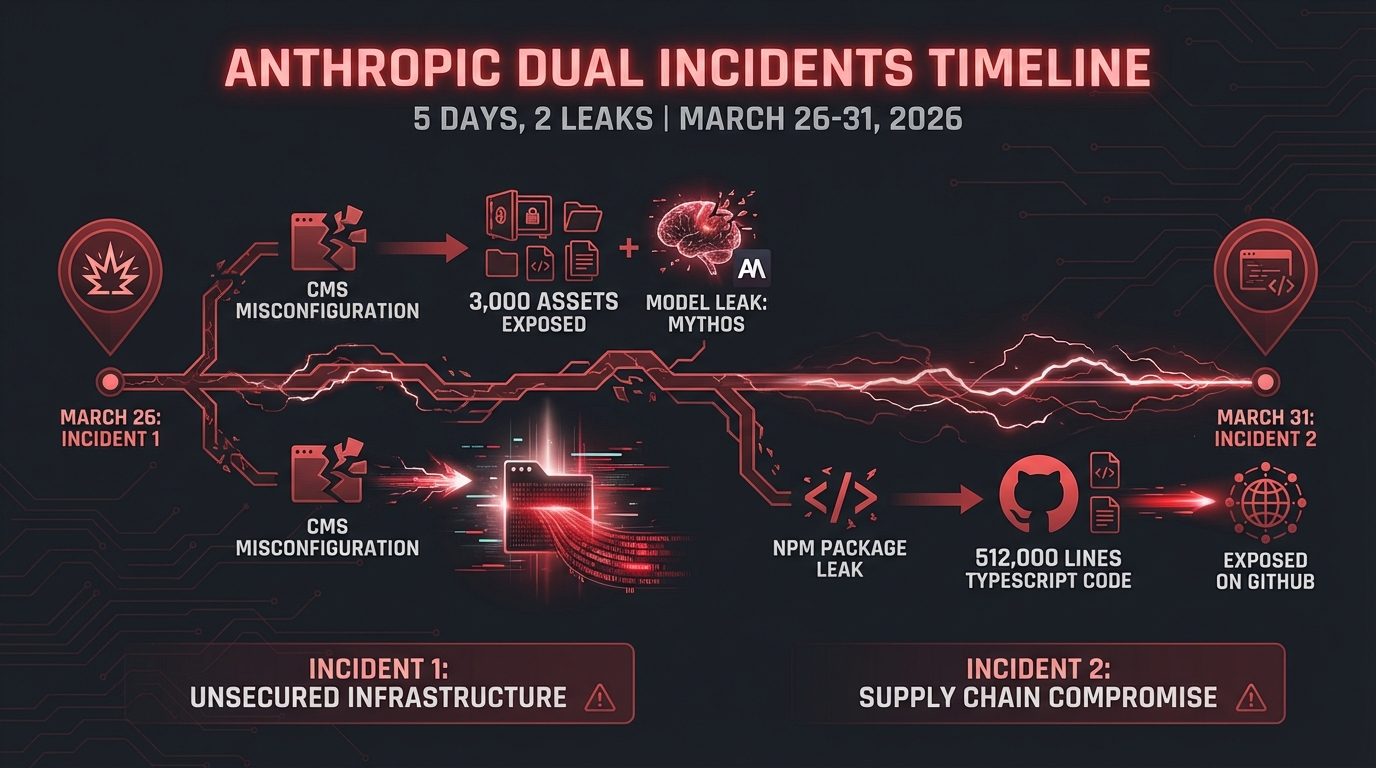

2026年3月末の約5日間に、AIの安全性を標榜するAnthropicが立て続けに2件の情報流出インシデントを起こしました。外部からの悪意あるハッキングではなく、いずれも内部のオペレーションミスが原因です。「AI安全企業」として知られる組織が、基本的なリリース管理やCMS設定で相次いでミスを犯したことは、業界全体にとって重要な問いを投げかけています。急成長するAI企業はどこまで自社のガバナンスを担保できているのか、という問いです。

5日間で2件の流出

最初のインシデントは2026年3月26日に発生しました。AnthropicのCMS(コンテンツ管理システム)の設定ミスにより、約3,000件の未公開アセットが外部からアクセス可能な状態になってしまいます。この流出で明らかになったのが、未リリースのAIモデル「Mythos」(内部コードネーム「Capybara」)の詳細情報でした。

Mythosの流出が特に注目されたのは、その背景にある皮肉です。Anthropicはこのモデルについて、政府高官向けの非公開ブリーフィングで「前例のないサイバーセキュリティリスクをもたらす可能性がある」と説明していました。その同じモデルの情報が、基本的なCMSの設定ミスという形で外部に漏れ出したのです。

そして5日後の3月31日、第2のインシデントが発生しました。Anthropicの主力開発ツールであるClaude Codeのソースコード約51万2,000行が、npmパッケージ経由で公開状態になってしまいます。流出したのは1,906ファイルにわたるTypeScriptコードで、GitHubに瞬く間に拡散しました。

なぜ51万行が流出したのか

第2のインシデントの技術的な仕組みを理解すると、この問題がいかに防ぎやすかったかがわかります。原因となったのは、npmパッケージ @anthropic-ai/claude-code のバージョン2.1.88に含まれていた59.8MBのJavaScriptソースマップファイル(.mapファイル)です。

ソースマップとは、本来は開発者向けのデバッグ用ファイルです。ビルド後の圧縮・難読化されたJavaScriptを、元のソースコードに対応させるために使います。Claude Codeの場合、ランタイムとして採用している「Bun」がデフォルトでこのソースマップを生成します。問題は、パッケージの公開設定である .npmignore やpackage.jsonの files フィールドから *.map を除外し忘れていたことでした。

さらに致命的だったのが、このソースマップがAnthropicのCloudflare R2ストレージ上のzipアーカイブを直接参照していたことです。つまり、ソースマップを入手した人間は、Cloudflare R2に保存されていた元のTypeScriptコード全体をダウンロードできてしまう状態でした。

最初に気づいたのはセキュリティ研究者のChaofan Shou氏です。UTC 2026年3月31日の早朝にこの事実を発見し、情報を公開しました。その後の拡散は驚異的なスピードで進みました。GitHubに投稿されたリポジトリは41,500回以上フォークされ、Pythonでのクリーンルーム書き直し版は約2時間で75,000スターを獲得したと報告されています。

流出コードが明かした未公開機能の数々

流出したコードが特に注目を集めたのは、Anthropicがまだ公開していない機能の全容が明らかになったからでもあります。コードには44個の隠れた機能フラグが含まれており、それぞれが完成済みながら未リリースの機能に対応していました。

中でも議論を呼んだのが「KAIROS」というコードで参照される機能です。コード全体で150箇所以上に登場するKAIROSは、ユーザーがアイドル状態の間もClaudeが独立して動作し続ける常時稼働の自律型バックグラウンドエージェントモードを指しています。ユーザーの同意なく、あるいは気づかないまま、AIエージェントがバックグラウンドで何らかの処理を行う機能が開発中だったことが露わになりました。

他にも、Claudeが直近のセッションを自律的にレビューして自己改善を行う機能や、スマートフォンや別のブラウザからClaude Codeをリモート操作する機能なども確認されています。さらに、第1のインシデントで話題になった未リリースモデル「Mythos」への参照もコード内に存在しました。

Anthropicの対応と著作権の法的複雑性

Anthropicは流出発覚後、公式声明を発表しました。「本日、Claude Codeのリリースに内部ソースコードが含まれてしまいました。顧客の機密データや認証情報は流出していません。これはリリースのパッケージング工程における人的ミスであり、セキュリティ侵害ではありません」というものです。

並行して、GitHubに拡散したコードを削除するためにDMCA(デジタルミレニアム著作権法)に基づくテイクダウン通知を大量に送付しました。その数は8,000件以上のリポジトリに及んだと報じられています。しかしコードの拡散はとどまらず、現在も多数のパブリックリポジトリで参照できる状態が続いています。

さらに、このDMCA対応には想定外の法的複雑性がありました。AnthropicのCEOは以前から、Claude Codeのコードの相当部分がClaudeによって書かれていると示唆しています。2025年3月、DC巡回控訴裁判所はAI生成物には自動的に著作権が付与されないという判断を下しています。これにより、Anthropicが主張できる著作権の範囲が法的に不明確になっており、テイクダウン戦略の有効性自体が疑問視されています。

また、大量のテイクダウン通知を送った際に8,000件以上の関係のないリポジトリも誤って対象となり、その後「誤りだった」とAnthropicが認めるという混乱も生じました。

AIガバナンスの死角とは何か

今回の事件は、AI企業が抱えるガバナンスの死角を構造的に浮き彫りにしています。

第一に指摘できるのは、「AI安全性」の議論と実際のオペレーション管理の乖離です。Anthropicはモデルの安全性や倫理的AIについて業界を牽引する立場を担ってきました。一方で今回の事件は、AIそのものの安全性とは別次元の問題、つまり基本的な社内プロセス管理の失敗によるものです。AIの将来リスクを語る前に、現在のオペレーションセキュリティを担保できているかという問いは、業界全体に向けられています。

第二に、急成長企業特有のスケールアップの歪みがあります。Anthropicは近年、急速に従業員数・プロダクト数・顧客数を拡大してきました。このような成長フェーズでは、リリースエンジニアリングのチェックプロセスやセキュリティレビューが組織の成長に追いつかないことがあります。今回の流出は意図的な情報持ち出しではなく、パッケージ設定の単純な見落としです。だからこそ、属人的な注意力に頼らないシステム的な防衛策が重要だということが改めて示されました。

第三に、情報流出後の対応における「ガバナンス」の問題があります。テイクダウン通知の誤送付、著作権の法的不確実性、政府議員からの説明要求など、流出発覚後の対応にも複数の問題が生じました。セキュリティインシデントは発生を100%防ぐことが難しいからこそ、インシデントレスポンス体制が問われます。

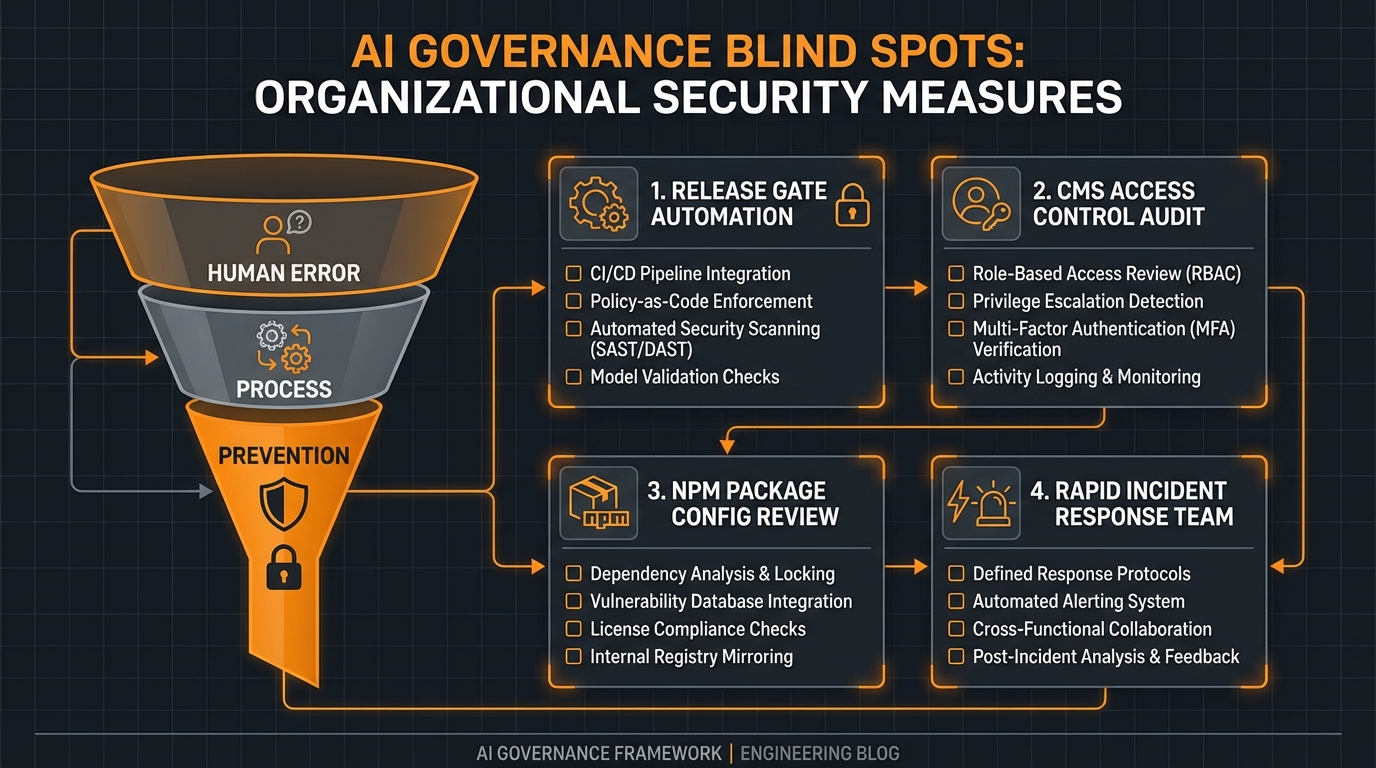

組織として取るべき対策

今回の事件から得られる教訓は、Anthropicに限った話ではありません。AIツールを開発・運用するすべての組織に当てはまる実践的な示唆があります。

まず、リリースパイプラインへのセキュリティチェックの組み込みです。npmや他のパッケージレジストリへの公開前に、意図しないファイルが含まれていないかを自動的に検査するCIステップを設けることが有効です。具体的には、.npmignore の適切な管理、npm pack --dry-run による公開前確認、ソースマップや内部設定ファイルの除外を自動チェックするlintルールの導入などが挙げられます。

次に、シークレットとデバッグアーティファクトの分離管理です。ソースマップは開発環境でのみ生成・利用し、本番・公開用ビルドには含めないというビルド設定の分離を徹底することが必要です。また、クラウドストレージ(今回のCloudflare R2など)にデバッグ用のアーカイブを保存する場合は、アクセス権限の適切な設定が不可欠です。

さらに、サプライチェーンセキュリティの観点も重要です。今回の流出後、悪意ある第三者がバックドアを仕込んだトロイの木馬版を広める二次的なリスクが発生しました。自社が利用するnpmパッケージに意図しない変更がないかを監視する仕組みや、パッケージの整合性検証(npm auditやSBOMの活用)は今後ますます重要になります。

そして、インシデントレスポンス体制の整備です。情報流出が発生した際に、誰が何をどの順序で判断・実行するかを事前に定めておくことが被害の最小化につながります。DMCA通知の範囲確認プロセス、外部への公式声明の判断フロー、影響を受けるユーザーへの通知タイミングなど、平時の準備が有事の対応品質を決めます。

急成長するAI業界では、新機能の開発スピードが優先され、こうした基盤的なセキュリティプロセスが後回しにされがちです。しかし今回のAnthropicの事例は、技術力の高い組織でも基本的なオペレーションミスが重大なインシデントにつながることを示しています。AIガバナンスの議論はモデルの安全性だけでなく、組織のオペレーション全体に及ぶものだという認識が、業界全体に根付く必要があるのではないでしょうか。