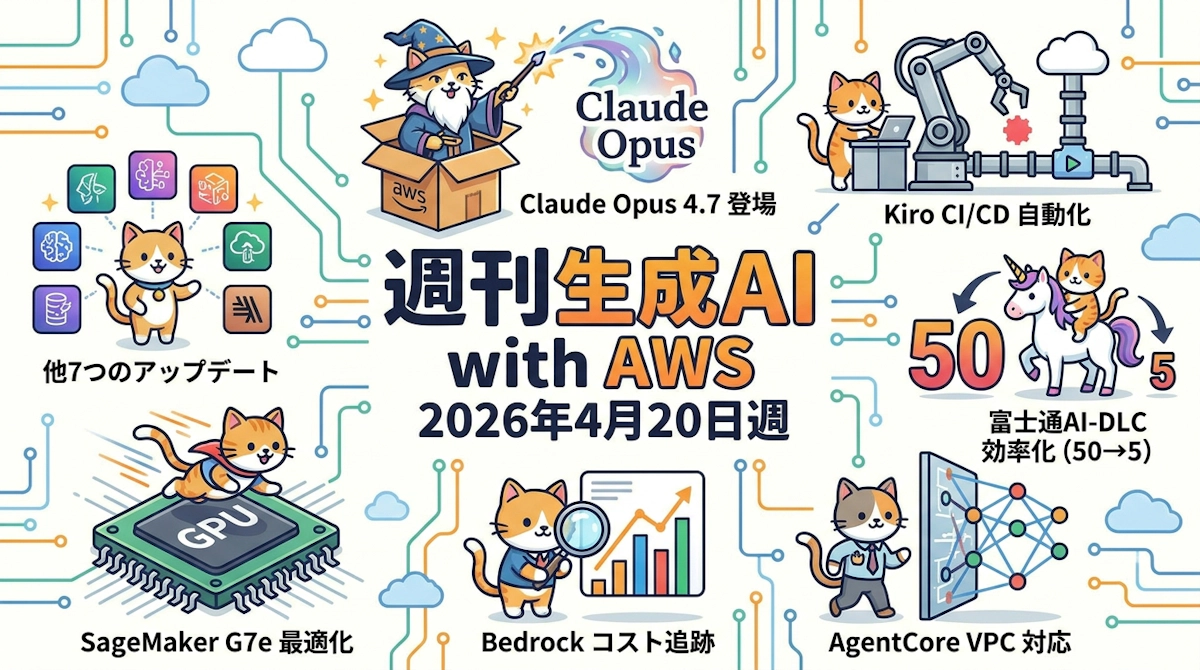

Claude Opus 4.7がAmazon BedrockとKiroで利用可能に

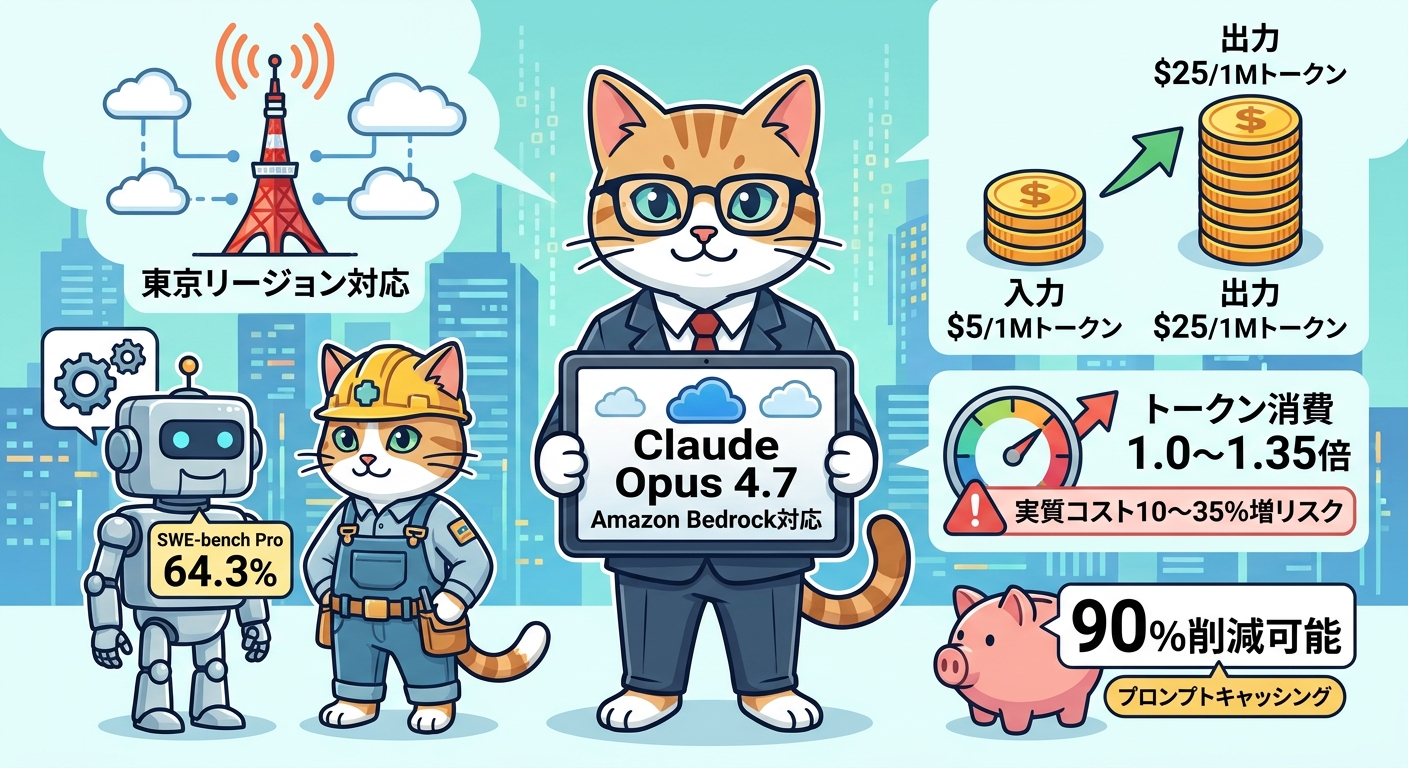

2026年4月第3週、AWS生成AIエコシステム最大のニュースとしてClaude Opus 4.7がAmazon Bedrockで利用可能になりました。Anthropicが同週にリリースした最新モデルで、東京リージョン(ap-northeast-1)を含む主要リージョンで即日対応しています。

性能面では、コーディングエージェントの実力を測るベンチマークSWE-bench Proで64.3%、SWE-bench Verifiedで87.6%を記録しており、前世代のOpus 4.6から大きく進化しています。特にエージェンティックなコーディング・長期自律作業・複雑なコード推論において向上が顕著で、マルチステップの開発タスクを任せるシナリオに向いています。

価格は入力$5.00・出力$25.00(1Mトークンあたり)で、プロンプトキャッシングを活用すると最大90%のコスト削減が可能です。ただし、新トークナイザーの導入により、同一テキストでも消費トークン数が従来比1.0〜1.35倍に増加するケースがあります。日本語・コード・表形式データでは1.2〜1.35倍に振れやすく、単価が据え置かれていても実質的なコストが10〜35%増加するリスクがあります。本番移行前にサンプルリクエストでトークン消費量を検証することをお勧めします。

Kiro IDEでも同様にClaude Opus 4.7が利用可能になりました。Pro・Pro+・Powerプラン向けに順次展開されており、IDE上でそのままOpus 4.7の能力を活かした開発が行えます。

富士通 AI-DLC Unicorn Gymから見えるエンタープライズAI開発の現在地

2026年3月11日〜13日の3日間、富士通様と共同で開催したAI-DLC(AI-Driven Like Coding)Unicorn Gymの実践事例が報告されました。7チーム・約40名が参加し、それぞれ実業務に近いテーマでAI支援開発に挑戦しました。

取り組んだテーマはCOBOLマイグレーション・AIエージェントプラットフォームの構築・Amazon Connectを使った自動電話システムなど、保守的な案件から最先端の構築まで多岐にわたります。注目すべきは、全7チームが3日間で動作するプロトタイプを完成させ、一部チームはAWS環境へのデプロイまで達成したことです。

参加チームが自己申告した生産性の改善数値は非常にインパクトがあります。

- 「50人月 → 5人月」

- 「24人月 → 2人日」

- 「18人月 → 15人日」

- 「14人月 → 1.5人月」

- 「4〜6ヶ月 → 2週間」

これらはあくまで参加者の自己申告であり、客観的な計測値ではありませんが、AIによる開発支援の可能性を示す象徴的な数字です。一方で、機能開発へのAI-DLC効果は全チームで確認できた反面、AWS環境構築やデプロイの部分では既存のAWSスキルと経験が前提となることも明らかになりました。AIが開発スピードを上げるためには、インフラの基礎知識は依然として重要です。

開発ツールとしてはKiroが中心的に使われており、aidlc-workflowsリソースを活用したテンプレート駆動の開発が実践されました。

Kiro CLIのヘッドレスモードでCI/CDにAIを組み込む

Kiro CLI 2.0(2026年4月13日リリース)の目玉機能としてヘッドレスモードが正式に提供開始されました。これにより、CI/CDパイプライン内からKiroをプログラマティックに実行できるようになります。

設定方法はシンプルで、KIRO_API_KEY環境変数を設定するだけです。ブラウザログインが不要になり、--no-interactiveフラグと組み合わせることで任意の自動化スクリプトからKiro CLIを呼び出せます。

代表的なユースケースを挙げます。

- プルリクエストの自動コードレビュー(CIで差分を渡してレビューコメントを生成)

- PR要約の自動生成

- 依存関係の定期監査(cronジョブによる定期実行)

- ビルド失敗時のトラブルシューティング自動化

- テストコードの自動生成

なお、ヘッドレスモードはPro・Pro+・Powerプランのみ対応しており、Freeプランでは利用できません。また、1コマンド1実行のシングルターン設計のため、対話的な作業には向かず、事前にプロンプトを定義したバッチ処理型のシナリオに最適です。APIキーはapp.kiro.dev/account/usageの「API Keys」セクションから発行できますが、作成時にしか表示されないため安全な場所への保存が必要です。

AgentCore GatewayのVPC egress対応とBedrockコスト可視化

Amazon Bedrock AgentCore GatewayにVPC egress対応(現在ベータ)が追加されました。これにより、EKSなどVPC内でホストしているMCPサーバーを、インターネットに公開することなくGatewayから呼び出せるようになります。Amazon VPC Latticeのプライベートエンドポイントを経由してアウトバウンド通信を行う仕組みで、GatewayターゲットにprivateEndpointを設定するだけで構成できます。

エンタープライズ環境では「内部ツール・社内データベースをAIエージェントに接続したいが、インターネット公開はできない」という要件が多くあります。このVPC egress対応はまさにそのニーズに応えるものです。ただし現在はベータ機能であるため、本番利用の際は最新のドキュメントを確認してください。

同週にはIAMプリンシパル単位でBedrockコストを追跡する新機能も発表されました(2026年4月9日)。IAMユーザーやロールにチーム・プロジェクト・コストセンターなどのタグを付けておくと、そのプリンシパルが発行したBedrockへのAPIコールコストがCUR 2.0(AWS Cost and Usage Report 2.0)とCost Explorerに自動的に記録されます。カスタムツール不要でチーム別・プロジェクト別のLLMコストが把握できるため、FinOpsの観点で非常に有用な機能です。対応はBedrockが利用可能な全商用リージョンで提供されています。

SageMaker AIの推論レコメンデーションとG7eインスタンスで推論コストを最適化

2026年4月22日、Amazon SageMaker AIが生成AIモデル向けの推論レコメンデーション機能に対応しました。自前でファインチューニングしたモデルを本番デプロイする際、最適なインスタンスタイプを選ぶのはこれまで手間のかかる作業でした。この機能では「コスト最小化」「レイテンシ最小化」「スループット最大化」の3つのパフォーマンス目標を指定するだけで、SageMaker AIがモデルアーキテクチャを分析し、複数インスタンスタイプ上で自動的に最適化・ベンチマークを実施して最適解を提案します。

新たに提供開始されたG7eインスタンス(NVIDIA RTX PRO 6000 Blackwell Server Edition GPU搭載)との組み合わせが特に注目です。G7eはG6e比でGPUメモリ2倍・メモリ帯域1.85倍・推論性能最大2.3倍を実現しています。さらに投機的デコーディング技術「EAGLE3」と組み合わせると、スループット2.4倍・コスト75%削減を達成でき、出力トークン単価はG6e比で約4分の1の$0.41/100万出力トークンになります。LLMの推論コストを本気で下げたい場合の有力な選択肢です。

AI for Scienceの潮流と文科省SPReADプログラム

AWSブログでは「AI for Science」という新しいパラダイムが紹介されています。AIを単なる道具としてではなく「共同研究者」として科学的発見に活用するアプローチで、2024年ノーベル化学賞をAlphaFold開発チームが受賞したことでも注目が高まっています。創薬・ゲノミクス・材料科学・気候科学などの分野で、生成AIが仮説生成や文献解析、シミュレーション最適化を担う事例が増えています。

このAI for Scienceの潮流を後押しするのが、文部科学省の「AI for Science萌芽的挑戦研究創出事業(SPReAD)」です。1課題あたり最大500万円(直接経費)を支援し、約1,000件の採択を目標とする大型プログラムです。注目すべきはAWS費用(計算リソース、APIコスト)が申請対象経費に含まれる点で、Amazon BedrockやSageMakerを活用した研究が対象となります。

第1回公募の締切は2026年5月18日正午(e-Rad経由)で、人文・社会科学から自然科学まで全分野が対象です。学生も応募可能であり、研究者だけでなく研究支援側のエンジニアにも関係する機会です。応募を検討されている方は早めに文部科学省の公募ページを確認してみてください。